Dzień dobry, tu Tomek Zieliński, autor bloga Informatyk Zakładowy. Słuchacie drugiego odcinka retro-podcastu, w ramach którego buszuję po starych magazynach komputerowych i opowiadam o rzeczach, które wydają mi się interesujące po 20, 25 i 30 latach. Mamy marzec 2026, więc przeglądam prasę z marca 1996, 2001 i 2006.

Uwagi edytorskie do wersji opublikowanej na blogu: wersję audio podcastu można znaleźć na YouTube, dostępny jest też plik MP3. Publikacja na platformach podcastowych pojawi się, gdy wreszcie wymyślę nazwę. Niżej znajdziesz transkrypcję całego 40-minutowego monologu (zapis tekstowy został nieznacznie zmodyfikowany aby lepiej się go czytało). Klikaj obrazki aby je powiększyć.

Zacznę od kilku ogłoszeń. Podcast nadal nie ma swojej nazwy. Jeśli do trzeciego odcinka czegoś nie wymyślę, to będzie to po prostu Podcast Informatyka Zakładowego. Nie jest to najgorsza nazwa. Na platformach podcastowych tego podcastu jeszcze nie ma, właśnie dlatego, że wciąż nie ma nazwy, ale pojawi się tam. Póki co odcinek drugi, tak samo jak pierwszy, trafi na YouTube. Dostępny też będzie plik MP3 do pobrania, no a pełna transkrypcja tego odcinka będzie dostępna na blogu razem z obrazkami.

Kilka osób zaproponowało, abym tworzył na YouTubie wideo z tymi obrazkami, które pojawiały się w tekście. Nie bardzo podoba mi się ten pomysł, bo do tego mojego gadania często byłby to jeden obrazek na 5-10 minut narracji. To oznacza, że ktoś, kto spoglądałby na takie wideo, nudziłby się, a ktoś kto chciałby tylko posłuchać miałby poczucie, że coś traci, bo zajmuje się czym innym – sprzątaniem czy prowadzeniem samochodu. Podcast jest tu dodatkiem, więc zdecydowałem się nie dodawać żadnych ilustracji do YouTube. Jeśli ktoś będzie chciał zobaczyć o czym mowa, zerknie sobie do transkrypcji.

Bardzo ucieszyło mnie ciepłe przyjęcie pierwszego odcinka. Dostałem, o ile dobrze policzyłem, jakieś 15 maili – wszystkie były miłe albo bardzo miłe. Nie jestem tym zaskoczony, bo o informację zwrotną poprosiłem na końcu odcinka pierwszego. Usłyszeli tylko ci, którzy dotrwali do końca odcinka. Jeśli komuś się nie podobało, odpadł po drodze, problem z głowy.

marzec 1996

Dobrze, przejdźmy do przeglądania czasopism z roku 1996. Jedna uwaga – wyleciał PC Kurier, doszedł magazyn Enter. I od tego magazynu zaczniemy właśnie przegląd roku 1996.

W numerze marcowym Entera możemy przeczytać wywiad ze Zbigniewem Malińskim, właścicielem firmy Malcom Systemy Komputerowe, która od roku 1987 wydawała edytor QR Tekst. Tutaj potrzebna jest mała dygresja.

W latach 80 i wcześniej, te edytory tekstu, które były dostępne na komputerach osobistych, służyły oczywiście do tego, żeby tekst przygotować a potem wydrukować na papierze. I te edytory wyglądały troszkę inaczej niż dzisiaj. Nie przypominały Worda i nie pozwalały podejrzeć, jak dany tekst będzie rzeczywiście wyglądał na papierze. Gdy oznaczaliśmy jakiś blok tekstu jako np. wycentrowany albo wyjustowany do prawej krawędzi wydruku, to na ekranie było to oznaczone jakimiś symbolami, ale ten tekst nie był rzeczywiście wycentrowany ani wyjustowany. Było tylko oznaczenie, że na wydruku będzie coś takiego.

Dopiero z graficznymi programami działającymi pod Windows pojawiły się możliwości podglądu wydruku, tzw. What You See Is What You Get (WYSIWYG), sprawdzenia, jak będzie wyglądała zawartość na papierze. W latach 80. i wcześniej takiej możliwości nie było – między innymi dlatego, że drukarki drukowały nie tylko na kartkach A4. Była np. składanka, czyli ciągła wstęga papieru z dziurkami po bokach (perforację można było potem oderwać). Były drukarki, które miały różną szerokość wałka więc jeśli chcieliśmy wypełnić wydruk tekstem, to komputer nie był w stanie pokazać tego na ekranie. Trzeba było tekst wydrukować i dopiero wtedy robić jakąś korektę.

Wracając do tematu – najpierw metryczka, która pojawia się obok tego wywiadu.

„Malcom jest największym polskim producentem oprogramowania użytkowego dla szerokich mas. Edytora QR Tekst oraz arkusza kalkulacyjnego QR Plan. QR Tekst otrzymał od redakcji PC Kuriera tytuły Produktu Roku – w 1993 roku za wersją 1.0 i w 1995 za wersją 2.0. Oba programy są w wersjach dla wszystkich popularnych systemów operacyjnych: DOS, Windows, różne wersje Unixa.”

Tutaj kolejna dygresja. W latach ‘80 o Unixach było wiadomo bardzo, bardzo mało. Jeśli ktoś nie pracował na wyższej uczelni technicznej, ani w dużym przedsiębiorstwie, które miało własny komputer, to wiedza była niedostępna, nie mówiło się o tym. W popularnych czasopismach komputerowych o Unixach nie było praktycznie niczego. Trudno mi więc powiedzieć, jak w tamtych czasach wyglądał rynek oprogramowania unixowego, w jaki sposób firma Malcom docierała do potencjalnych odbiorców, no ale wyraźnie taki rynek był – w dalszej części tej metryczki czytamy, że obecnie na polskim rynku zostało sprzedanych około 80 tysięcy licencji QR Textu.

Przypominam, że mówimy o roku 1996. Te 80 tysięcy to naprawdę spektakularny wynik. Dość powiedzieć, że trzy lata później, w roku 1999, wydano grę Baldur’s Gate, która w Polsce była zlokalizowana w sposób profesjonalny, z polską drukowaną instrukcją, z profesjonalnym dubbingiem, w którym wzięli udział znani aktorzy – była to superprodukcja, pierwsza tego typu w Polsce, a sprzedała się w spektakularnym nakładzie 50 tysięcy egzemplarzy. Zwykłe gry, które były rozprowadzane w Polsce (mowa oczywiście o oryginałach) sprzedawały się co najwyżej w kilku tysiącach egzemplarzy. Owe 50 tysięcy egzemplarzy gry było spektakularnym sukcesem, no a przecież gry sprzedają się lekko licząc dziesięć razy lepiej niż programy użytkowe.

Tak więc – 80 tysięcy licencji QR Textu to było naprawdę duże osiągnięcie i oznaczało milionowe przychody. Na ten wywiad zwróciłem jednak uwagę z troszkę innych powodów. Pan Zbigniew Maliński, właściciel i prezes firmy Malcom, sporą część wywiadu poświęca na narzekanie na swoich pracowników.

Redakcja: Część z nich w rozmowie z nami twierdziła, że pan ma mało cierpliwości, stanowczo za mało, aby produkować oprogramowanie.

Zbigniew Maliński: Mnie się wydaje, że przez te wszystkie lata wykazywałem dużo cierpliwości, momentami zbyt dużo.

R: Podobno ciągle ich pan poganiał, przerywał pracę w połowie drogi.

ZM: Konflikt na gruncie programiści i producent występuje zawsze. Programistom się wydaje, że kierują projektem, a oni tymczasem kodują program. […] Polscy programiści nie mają za grosz wyczucia rynku. Są znakomitymi fachowcami, świetnie zdającymi swoje narzędzia, ale sami nie pracują zbyt dużo z edytorem. Nie rozmawiają z klientami i użytkownikami. Programista nie jest w stanie określić, kiedy powiedzieć dość. Dla niego dobry jest wrogiem lepszego. Ciągle brakuje mu miesiąca, aby już to skończyć naprawdę. […]

R: Jak pan sobie radzi z takimi ambitnymi programistami?

ZM: Na to jest tylko jedna sprawdzona metoda. Zatwierdzam konkretną wersję, zabieram ją programistom i oddaję na zewnątrz firmy – broń Boże wewnątrz! – komuś, kto zrobi dokumentację. Staram się przy tym dobrze izolować osoby sporządzającą dokumentację od programistów. […]. Gdy programista jest na etacie, to mu się nie spieszy. A to jest biznes i to są moje pieniądze.

Mam nadzieję, że nie zirytowała was moja gra aktorska – tak właśnie wyobrażam sobie, że ten wywiad mógł brzmieć. To było zdumiewające. To znaczy, okej, tego typu wywiady bywają strasznie nudne, gdy właściciele mówią tylko jakieś takie okrągłe zdania, nic nie znaczące kwestie o tym, że wyczuwamy potrzeby rynku, dostarczamy najlepszy produkt, pracujemy z najlepszymi ludźmi i tak dalej. Troszkę ciekawiej jest, gdy w wywiadzie pojawia się jakaś informacja o tym, jak taka produkcja wygląda od kuchni, jakie wyzwania się pojawiają. No ale żeby prezes w wywiadzie dla ogólnopolskiego miesięcznika pojeżdżał po swoich pracownikach i mówił, jakim trudem i jakim bólem jest współpraca, tego się jednak nie spotykało nawet wtedy.

I to oczywiście może być prawda, że człowiek, który nie miał fachowego przygotowania, nie miał świadomości, jak wyglądają jakieś realia czy zasady prowadzenia projektów programistycznych, mógł robić rzeczy na czuja i prowadzić ten swój zespół w taki sposób, że troszkę go to antagonizowało z załogą – ale to chyba nie do końca zagrało. Dość powiedzieć, że wywiad miał miejsce w roku 1996, QR Text 2.0 wydano rok wcześniej, w roku 1995, i była to ostatnia wersja. Kolejna już nie powstała.

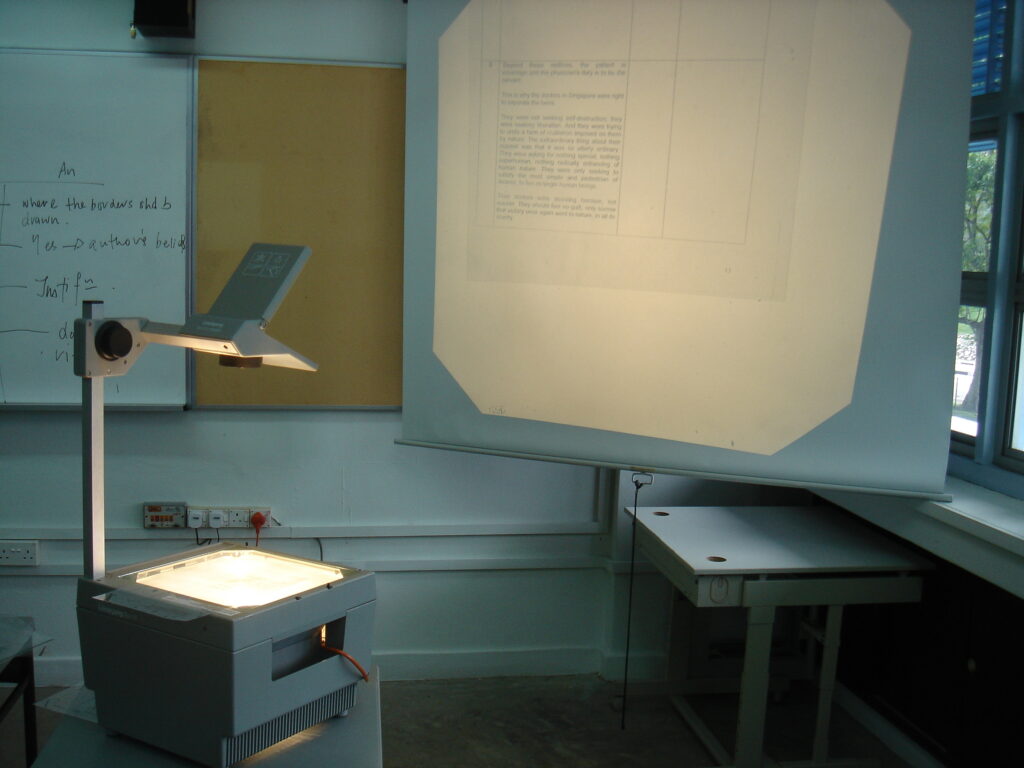

Przejdźmy do czasopisma PC World Komputer, numer marcowy 1996. Przy okazji testu laptopów znajduje się tam ramka opisująca produkt, który istniał bardzo krótko i jest tak naprawdę kompletnie zapomniany. Mowa o panelach projekcyjnych. Aby opowiedzieć, czym były panele projekcyjne, najpierw wymagany jest krótki wstęp.

Gdy dzisiaj chcemy obraz z komputera rzucić na ścianę, by pokazać prezentację szerszemu audytorium, korzystamy z projektorów – jakaś tam skrzyneczka, silne źródło światła, w obudowie obiektyw, między źródłem światła a obiektywem jest jakiś panel ciekłokrystaliczny i obraz z tego panela rzucany jest na ścianę. Natomiast dawniej i w szkołach i w zakładach pracy – gdy mieliśmy jeszcze do czynienia z technologiami analogowymi, gdy nie było jeszcze komputerów – w użyciu były tak zwane grafoskopy.

foto mailer_diablo, licencja CC BY-SA 3.0

Jeśli ktoś chce zobaczyć, o czym mowa, to może wpisać sobie w Wikipedię właśnie hasło grafoskop – urządzenie, które pozwalało wyświetlać na ścianie zawartość folii. Było rozmiarów mniej więcej drukarki laserowej, wewnątrz było silne źródło światła, na górze obudowy była mleczna szyba, na którą kładło się folię z zawartością do wyświetlania. W tej mlecznej szybie była jeszcze soczewka Fresnela, aby skupić światło przechodzące przez folię, a za pomocą lustra obraz był rzucany na ścianę.

Wracając do paneli projekcyjnych – były to urządzenia, które pozwalały wyświetlić na ścianie obraz z komputera przy pomocy grafoskopu. Możemy wyobrazić sobie panel projekcyjny jako ekran ciekłokrystaliczny wyciągnięty z laptopa, który nie ma od spodu podświetlenia, tylko jest przezroczystą ramką, przez którą może przeświecać światło.

Sposób użycia panelu projekcyjnego był dość intuicyjny. Włączaliśmy grafoskop, który wyświetlał na ścianie nic. Kładliśmy panel projekcyjny na środku grafoskopu w taki sposób, aby źródło światła świeciło przez ekran ciekłokrystaliczny, obraz skupiał się w soczewce i był za pomocą lustra rzucany na ścianę. Oczywiście wymagało to regulacji ostrości za pomocą pokrętła, którym unosiliśmy lub opuszczaliśmy ramię z soczewką i lustrem. Takie urządzenie można było użyć wszędzie tam, gdzie grafoskop już był.

Kosztowało to straszliwie dużo. Cena tych urządzeń przekraczała czasem nawet dwukrotnie cenę laptopa – zapewne z tego powodu, że były produkowane w niewielkich seriach i sprzedawane w niewielkich ilościach. W Polsce panel projekcyjny mógł kosztować kilkanaście średnich pensji, a to oznacza, że byłby urządzeniem bardzo drogim, na które trzeba po prostu uważać. Gdy już mieliśmy do wyboru: bardzo drogi panel projekcyjny, albo bardzo drogi projektor, no to być może projektor – który dało się również zapakować do torby i zabrać do klienta – był zwyczajnie lepszym wyborem.

Przejdźmy do marcowego numeru CHIP-a. Znajduje się tam tekst opisujący postać Stanisława Lema, wówczas jeszcze żyjącego (Lem zmarł w roku 2006). Znalazł się tam krótki wywiad, cytuję fragment: „- Redakcja: Jak ocenia Pan przyszłość społeczeństwa ery informacyjnej? – Stanisław Lem: Jestem do niej nastawiony niezwykle sceptycznie. Z jednej strony dlatego, iż sieci komputerowe otwierają ogromne możliwości dla działalności kryminalnej, z drugiej zaś ze względu na to, że człowiek kompletnie nie potrafi poradzić sobie z ogromem napływających z zewnątrz informacji. Nasz umysł i nasza świadomość dysponują wciąż tą samą pojemnością co w paleolicie, czyli przed setkami tysięcy lat. I nagle dziś jesteśmy zalewani potokiem informacji, chociaż ludzkie urządzenia I/O nie uległy modyfikacji.”

To jest oczywiście wszystko prawda, to znaczy zgadzam się z panem Lemem jak nigdy wcześniej, ale on nie przewidział wszystkiego. Miał świadomość, że w internecie dostępna będzie cała wiedza ludzkości, i że 99% ludzkości nie będzie wcale zainteresowana czerpaniem tej wiedzy. Natomiast z całą pewnością nie przewidział tego, że durnowate rolki na TikToku albo patostreamy będą miały popularność dwa lub trzy rzędy wielkości większą niż na przykład kanały z treściami naukowymi. Stanisław Lem przewidywał, że nie będzie tu za wiele dobrego, ale nie zdawał sobie sprawy z tego, jaki ściek pojawi się w internecie, gdy stanie się on masowo dostępny.

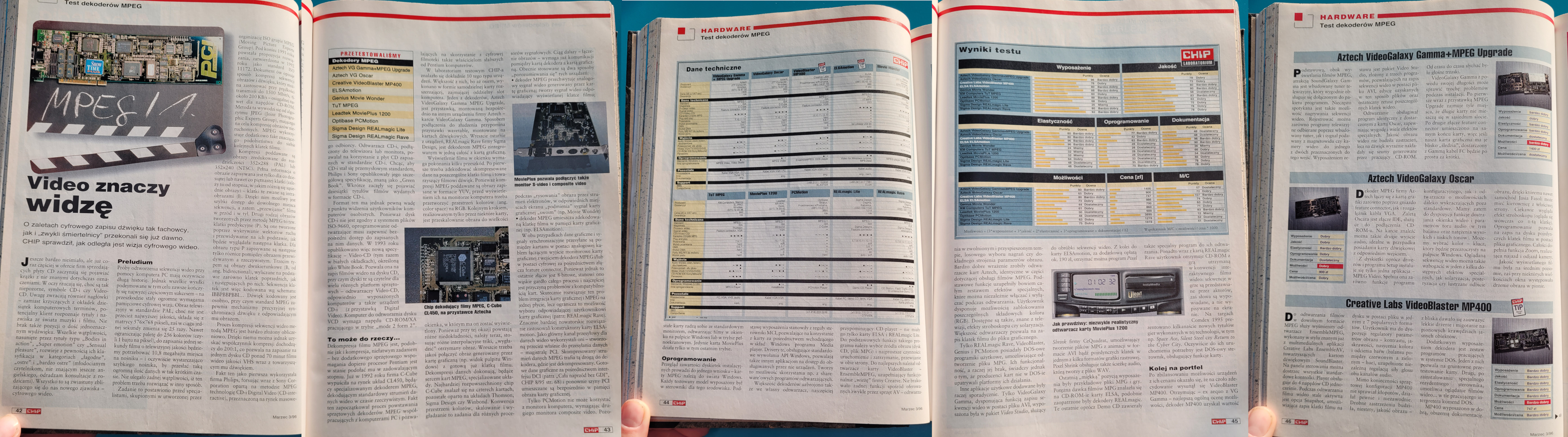

W tym samym numerze CHIP-a czytamy też artykuł o kartach dekodujących wideo w standardzie MPEG-2. Im bardziej skompresowane jest wideo, tym więcej mocy obliczeniowej wymagane jest do zdekodowania ruchomych obrazów. Gdy mowa o standardzie MPEG-2, zdekodowanie takich animacji przy użyciu procesora wymagało co najmniej Pentium 90 lub wyżej. Ponieważ w roku 1996 dość popularne były wolniejsze komputery, przez krótki czas zaistniała taka kategoria urządzeń jak karty dekodujące MPEG-2.

W tamtych czasach duże pliki MPEG-2 spotykano głównie na płytach w standardzie VideoCD. Był to obrazy o rozdzielczości 352×288 pikseli w 25 klatkach na sekundę – na dzisiejsze standardy jest to absolutnie fatalna jakość, wtedy też nie była najlepsza. Natomiast przez pewien czas dystrybuowano filmy w standardzie VideoCD np. jako darmowe dodatki do miesięczników, więc niektórzy gromadzili sobie kolekcje filmów w tym standardzie.

Jeśli osoby te miały za słaby komputer, mogły być zainteresowane taką kartą do dekodowania – a raczej mogłyby, gdyby nie to, że te karty były za drogie. Karta kosztowała około średniej pensji, czasem półtora. Znacznie lepszą inwestycją był więc szybszy procesor, albo dokupienie pamięci. Było też wiadomo, że nowe modele komputerów, nowe modele procesorów, które pojawią się za pół roku albo za rok, będą po prostu w stanie zrobić tą robotę w całości programowo, bez konieczności kupowania dodatkowego sprzętu.

Karty do dekodowania wideo mogły działać na jeden z kilku sposobów. W pierwszym karta „wmiksowywała” swój sygnał po drodze – kabel z karty graficznej wchodził do dekodera a z dekodera szedł do monitora. Karta dekodowała kolejne klatki i wstawiała je w te współrzędne ekranu, które przekazał jej sterownik. Drugą możliwością było dekodowanie kolejnych klatek animacji i wstawianie ich do pamięci RAM, skąd programowy odtwarzacz pobierał je i umieszczał w buforze ramki, skąd trafiały na ekran. Tylko jedna karta z wówczas przetestowanych wykorzystywała magistralę PCI, co pozwalało zdekodowany obraz wstawiać od razu do pamięci karty wideo.

Ktoś mógłby zapytać, jak to możliwe, że większość komputerów nie posiadała takiego sprzętu do dekodowania wideo, a jednocześnie popularne były takie publikacje multimedialne jak np. encyklopedia Encarta. Odpowiedź jest prosta – w pierwszych tego typu publikacjach, czyli w encyklopediach multimedialnych albo encyklopediach tematycznych, pliki wideo były miały bardzo małą rozdzielczość, niekiedy zaledwie 160×120 pikseli, taki znaczek pocztowy. Często te pliki wideo były całkowicie nieskompresowane albo skompresowane bardzo prostymi algorytmami, które działały bardzo szybko, np. RLE, ale kompresowały ten strumień słabo. Czyli tak naprawdę mimo, że rozdzielczość tych klipów była bardzo słaba, to zajmowały zaskakująco dużo miejsca. Natomiast pozwalały na dekodowanie nawet na bardzo słabych komputerach.

marzec 2001

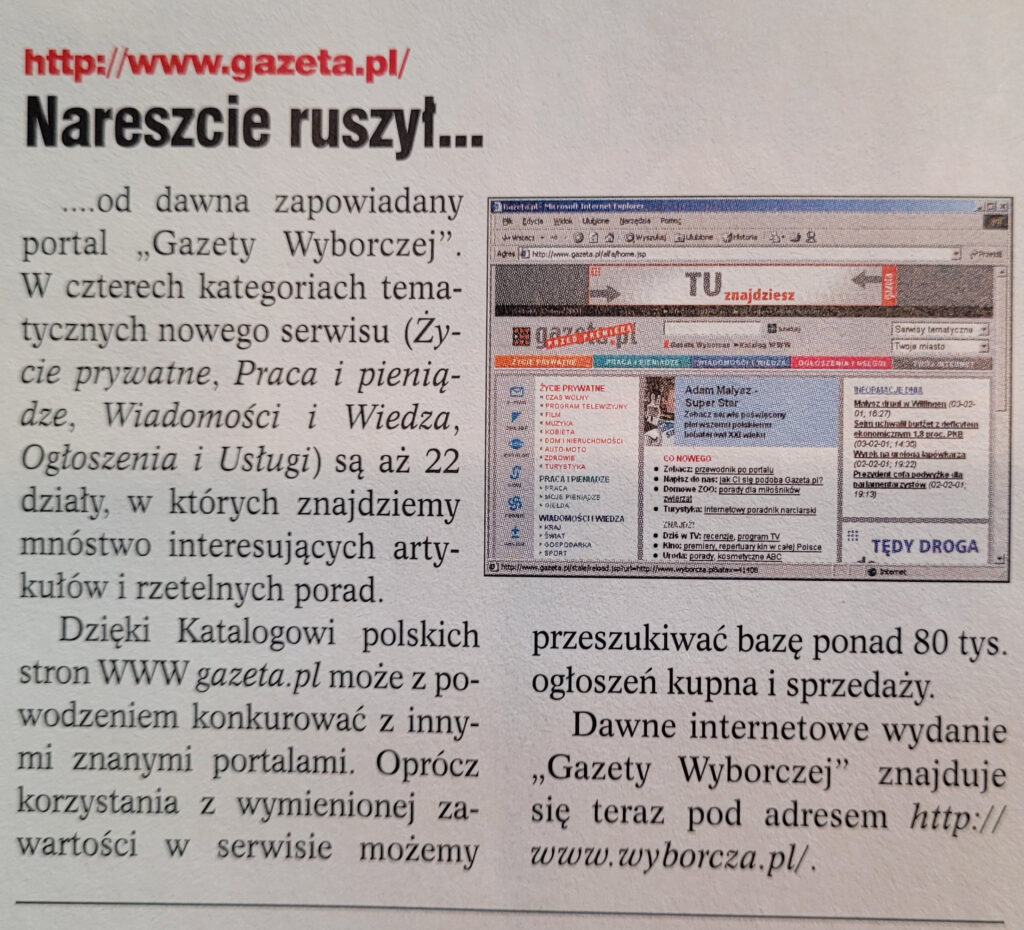

Rok 2001. W marcowym numerze CHIP-a z tego roku moją uwagę zwróciły dwie krótkie notatki. Pierwsza jest następująca: „nareszcie ruszył od dawna zapowiadany portal Gazety Wyborczej pod adresem www.gazeta.pl. W czterech kategoriach tematycznych nowego serwisu są aż 22 działy, w których znajdziemy mnóstwo interesujących artykułów i rzetelnych porad […] Dawne internetowe wydanie Gazety Wyborczej znajduje się teraz pod adresem www.wyborcza.pl”.

Moja refleksja – nie przypominam sobie w polskim internecie ani jednego rebrandingu, który poszedłby tak fatalnie. Przez ileś lat internetowe wydanie Gazety Wyborczej było dostępne pod adresem gazeta.pl, a następnie zostało przeniesione pod inny adres, natomiast gazeta.pl stała się portalem internetowym – nikt tego nie rozumiał. Minęło 25 lat, a ludziom nadal się to pierdzieli. Nadal redaktorzy Gazety Wyborczej zgarniają opieprz za klikbajty albo za kiepską jakość tekstów w portalu gazeta.pl. Przez to, że zarówno portal, jak i sam dziennik są wydawane przez ten sam koncern Agora, ludzie sklejają je w głowach w jeden byt. Dla bardzo dużej części ludzi Gazeta Wyborcza, Wyborcza.pl oraz Gazeta.pl to jest jedno i to samo. Ciężko naprawdę o bardziej spektakularną porażkę, jeśli chodzi o nazewnictwo czegoś w polskim internecie.

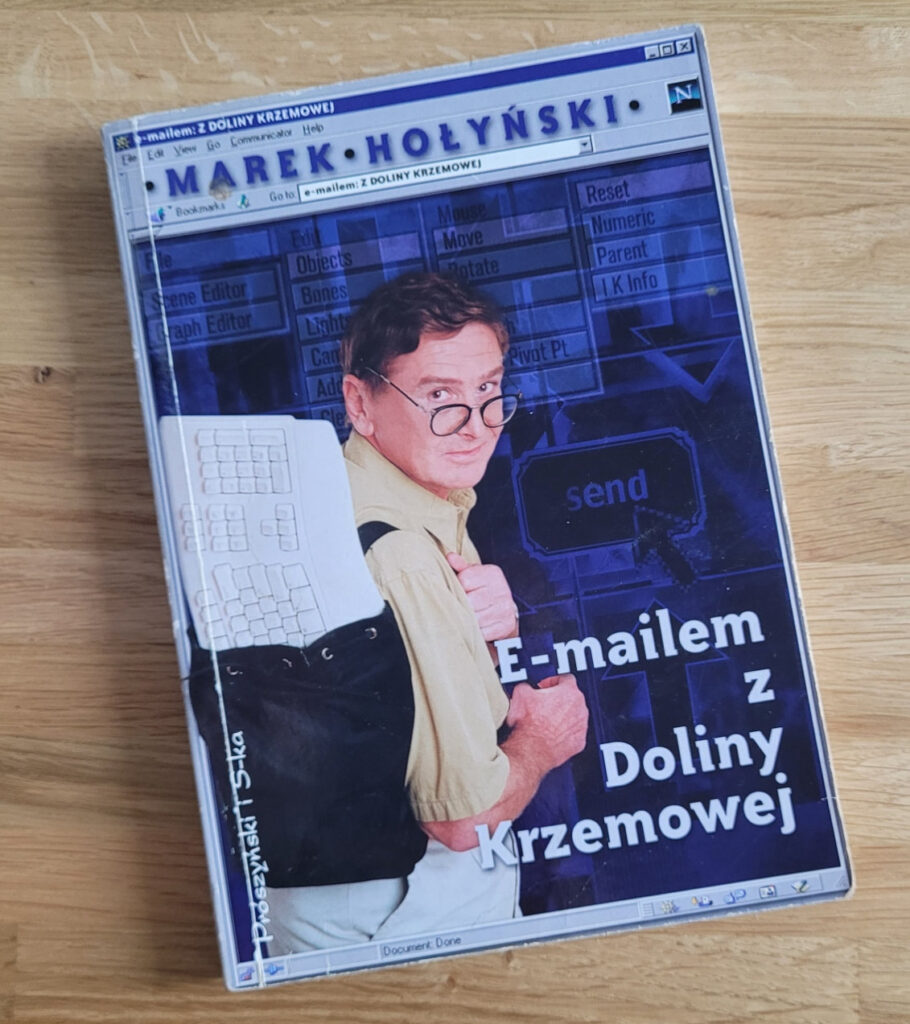

Drugą notką, na którą zwróciłem uwagę, jest informacja o wydaniu książki Marka Hołyńskiego „E-mailem z Doliny Krzemowej”. Profesor Hołyński wyemigrował z Polski do USA na początku lat 80. i przez dekadę wykładał grafikę komputerową na Uniwersytecie Bostońskim i MIT (Massachusetts Institute of Technology). Następnie w latach 90. pracował w Silicon Graphics (SGI), firmie odpowiedzialnej za produkcję pierwszych, poważnych stacji graficznych, za pomocą których przygotowano na przykład efekty specjalne do filmu Park Jurajski w roku 1993.

Marek Hołyński pisywał w tym czasie felietony, które były publikowane na łamach Nowej Fantastyki, Gazety Wyborczej, Polityki, Wprostu czy Wiedzy i Życia i opisywał tam, jak wygląda życie, jak wygląda praca w Dolinie Krzemowej, bo tak naprawdę w tamtych czasach nie wiedzieliśmy o tym praktycznie nic. OK, potem koledzy ze studiów wyemigrowali do USA, zahaczyli się w takich firmach jak np. Microsoft, no i podczas odwiedzin w Polsce opowiadali, jak jest. Ileś lat później mieliśmy serial Halt and Catch Fire, który również opowiadał o tym, jak rozwijała się Dolina Krzemowa. Potem oczywiście absolutnie wspaniały serial Silicon Valley, który jeden do jednego przedstawiał wszystkie patologie i wszystkie dziwactwa, które pojawiły się tam dwie dekady później. Ale w roku 2001 lektura książki profesora Hołyńskiego była tak naprawdę jedynym źródłem informacji o tym, co się tam dzieje i jak to wygląda.

W marcowym numerze PC World Komputera z roku 2001 opisywany jest temat wideokonferencji, czyli przesyłania obrazu i dźwięku na odległość. W roku 2001 faktycznie trzeba to było objaśniać – kamerki internetowe były rzadkością, nawet w laptopach pojawiły się jako standardowe wyposażenie dopiero w połowie lat zerowych. No i ok, o ile wcześniej temat był znany pasjonatom czy zapaleńcom, którzy w internecie siedzieli wcześniej – program NetMeeting był dostępny już w drugiej połowie lat 90 – to tak naprawdę znakomita większość użytkowników komputerów i wczesnego internetu nie wiedziała, że możliwe jest nie tylko rozmawianie przez internet, ale także prowadzenie wideokonferencji.

Tutaj moje osobiste doświadczenie jest takie, że gdy w roku 2007-2008 pracowałem jako programista w firmie, która była polskim oddziałem szwajcarskiego koncernu, telekonferencje z centralą prowadziliśmy za pomocą specjalizowanego sprzętu opartego o linię ISDN – cyfrową telefonię, która pozwalała na osiągnięcie przepustowości punkt do punktu 128 kilobitów na sekundę.

Działało to bardzo dobrze, natomiast kosztowało jakieś chore pieniądze. Nie pamiętam dokładnych kwot, tym bardziej, że częściej dzwoniła do nas Szwajcaria, ale jedna godzina telekonferencji ze Szwajcarią to było tak około 10% pensji polskiego dewelopera. Czyli 10 godzin rozmawiania z centralą oznaczało tak naprawdę koszt będący dodatkowym etatem. Oczywiście byliśmy zachęcani do tego, żeby korzystać tylko wtedy, kiedy jest to potrzebne – bo tak naprawdę powyżej iluś godzin telekonferencji bardziej opłacało się polecieć do Szwajcarii i odwiedzić centralę osobiście, niż siedzieć na kamerce.

Z kolei, gdy w 2011 roku pracowałem w Microsofcie, to wtedy wszystkie telekonferencje były już oczywiście robione przez internet, ale na dedykowanym sprzęcie. Ponieważ był to Microsoft, więc pieniędzy na wyposażenie sal konferencyjnych nie brakowało i był to hardware przeznaczony dla oprogramowania o nazwie Microsoft Lync, który potem został dużo później przemianowany na Skype for Business (nie mylić z regularnym Skype’em, który był zupełnie innym produktem). Skype for Business został z kolei zastąpiony Teamsami.

Sprzęt, który wtedy mieliśmy był szczytowym osiągnięciem, gdy mowa o telekonferencjach, w których brałem w życiu udział. Były np. meduzy czyli urządzenia, które leżały na stole, miały w sobie głośnik, ale miały też zestaw mikrofonów kierunkowych, dzięki czemu można było wyraźnie słyszeć nawet osobę, która mówiła coś siedząc dalej od urządzenia.

Był też sprzęt o nazwie Microsoft RoundTable, czyli urządzenie do telekonferencji, mające oprócz głośnika także zestaw mikrofonów i kamerek, które patrzyły dookoła. Widok 360 stopni zapewniały pryzmatyczne lustra, które pozwalały oglądać cały pokój i wszystkich zgromadzonych przy stole jednocześnie. Dzięki temu, że oprogramowanie tego było naprawdę dopracowane, sprzęt ten pozwalał na przykład wyświetlić wszystkie twarze (rozpoznawane automatycznie) i wyróżnić osobę, która w danej chwili mówiła.

Ciężko opowiedzieć o doświadczeniach z wideokonferencji, ale jeśli chodzi o przyjemność i wygodę, to był naprawdę szczyt tego, czego doświadczyłem. Późniejsze kamerki w laptopach albo nad monitorami i mikrofony albo zestawy słuchawkowe – to już było słabsze. I działało dostatecznie dobrze tylko w sytuacji, kiedy każdy ma swój komputer, każdy gapi się w swoją kamerkę, no bo jeśli mieliśmy do czynienia z sytuacją, gdy dwa zespoły chciały się spotkać w dwóch salkach konferencyjnych, no to dzisiaj nie ma już takich tak wygodnych rozwiązań. Wiadomo, jest kwestia kosztów, zestaw słuchawkowy na Bluetooth będzie dużo tańszy niż urządzenie Microsoft RoundTable z zestawem dedykowanych kamer i mikrofonów, no ale przyjemność z takiej wideokonferencji jest dzisiaj dużo mniejsza niż było kiedyś.

Magazyn Enter nr 3/2001. Moją uwagę zwrócił artykuł o kluczach sprzętowych HASP, czyli sprzęcie do zwalczania piractwa oprogramowania (marka jest skrótem frazy Hardware Against Software Piracy). Klucze sprzętowe były urządzeniami, które pozwalały firmom tworzącym oprogramowanie walczyć z piractwem. Razem z programem użytkownik otrzymywał klucz sprzętowy, albo podłączany do portu równoległego, czyli portu drukarki, albo podłączany do portu USB.

W starszych wersjach program sprawdzał po prostu, czy taki klucz jest obecny. A ponieważ takie sprawdzenie można było w łatwy sposób symulować, albo zablokować, zrobić jakiegoś cracka modyfikującego plik wykonywalny tak, aby pomijał takie sprawdzenie, w kolejnych wersjach program zabezpieczony kluczem sprzętowym miał jakiś zaszyfrowany fragment, a klucz do odszyfrowania tego fragmentu tej biblioteki był umieszczony w kluczu sprzętowym.

Oczywiście to również dało się się omijać. Można było taki zaszyfrowany fragment po prostu podmienić i w ten sposób właśnie rozwijało się piractwo programów chronionych przez klucze sprzętowe. Ponieważ sam pojedynczy klucz, który producent oprogramowania musiał wysłać do klienta, kosztował kilkaset złotych za sztukę, w ten sposób chronione były tylko bardzo drogie programy, które kosztowały po kilkanaście albo kilkadziesiąt tysięcy – na przykład AutoCAD. A ponieważ studenci architektury i tak potrzebowali własnej „kopii bezpieczeństwa”, która działałaby bez klucza sprzętowego, to piraci znajdowali skuteczne sposoby na klucze sprzętowe i pirackich wersji AutoCada można było używać bez żadnego problemu.

marzec 2006

Rok 2006. W marcowym numerze CHIP-a uwagę zwraca artykuł o zawirowaniach wokół MKS_vir, czyli programie antywirusowym tworzonym przez wiele lat przez pana Marka Sella. Marek Sell zmarł w czerwcu roku 2004 i natychmiast pojawił się konflikt między jego spadkobiercami, a pracownikami i zarządem firmy – pan Marek nie zostawił testamentu.

Według relacji gwałtownie pogorszyła się atmosfera pracy, pracownicy nie byli pewni stabilności i przyszłości firmy i w takiej sytuacji wszyscy programiści MKS założyli we wrześniu 2004 własną spółkę o nazwie Arcabit i zaczęli tworzyć własne oprogramowanie antywirusowe. Firmie MKS zabrakło rąk do pracy – nie dało się szybko znaleźć ludzi, bo taka praca wymaga bardzo wysokich kwalifikacji, więc firma była zmuszona do podjęcia współpracy z Arcabit i kupowania usług takich jak na przykład przygotowanie aktualizacji bazy wirusów z nowymi sygnaturami wirusów, które pojawiały się w kolejnych tygodniach i miesiącach.

W roku 2005 rozpoczęły się spory i donosy o możliwości popełnienia przestępstwa. Firma MKS zerwała współpracę i oskarżyła Arcabit o bezprawne wykorzystanie tajemnic przedsiębiorstwa. Artykuł z CHIP-a opisuje przygotowania do batalii prawnej. Nie śledziłem tego co działo się w kolejnych latach, ale gdy zajrzymy do Wikipedii to dowiemy się, że po upadku firmy MKS w 2011 roku syndyk sprzedał prawa do marki MKS_vir firmie Arcabit, zaś Arcabit działa po dziś dzień i oferuje produkty pod obiema markami, czyli zarówno Arcabit jak i MKS_vir.

Innym artykułem z tego numeru CHIP-a jest test 33 analogowych tunerów telewizyjnych, czyli sprzętu, który pozwalał odbierać i oglądać telewizję na ekranie komputera. Mówimy tu oczywiście o telewizji analogowej, ponieważ sygnał cyfrowy DVB-T wprowadzano między rokiem 2010 a rokiem 2013, czyli kilka lat później. Jeśli chodzi o odbiór telewizji na komputerach to z anteną działało to średnio, ale z kablówką już całkiem dobrze.

Urządzenia te miały piloty, pozwalały na pauzowanie odtwarzania, na time-shifting (opóźnione rozpoczęcie oglądania a potem przeskakiwanie reklam). Niektóre z tych tunerów miały układy do sprzętowego kodowania MPEG-2 albo MPEG-4, więc można było rejestrować programy telewizyjnych w tle – plus takie udogodnienia, jak na przykład telegazeta, która mogła załadować wszystkie strony jednocześnie i trzymać je w pamięci. Można też było odbierać radio. Ludzie, którzy mieli komputer i małe mieszkania, mogli zastąpić sobie osobny odbiornik telewizyjny takim właśnie tunerem – tym bardziej, że były to urządzenia tanie, kosztujące między 100 a 200 złotych.

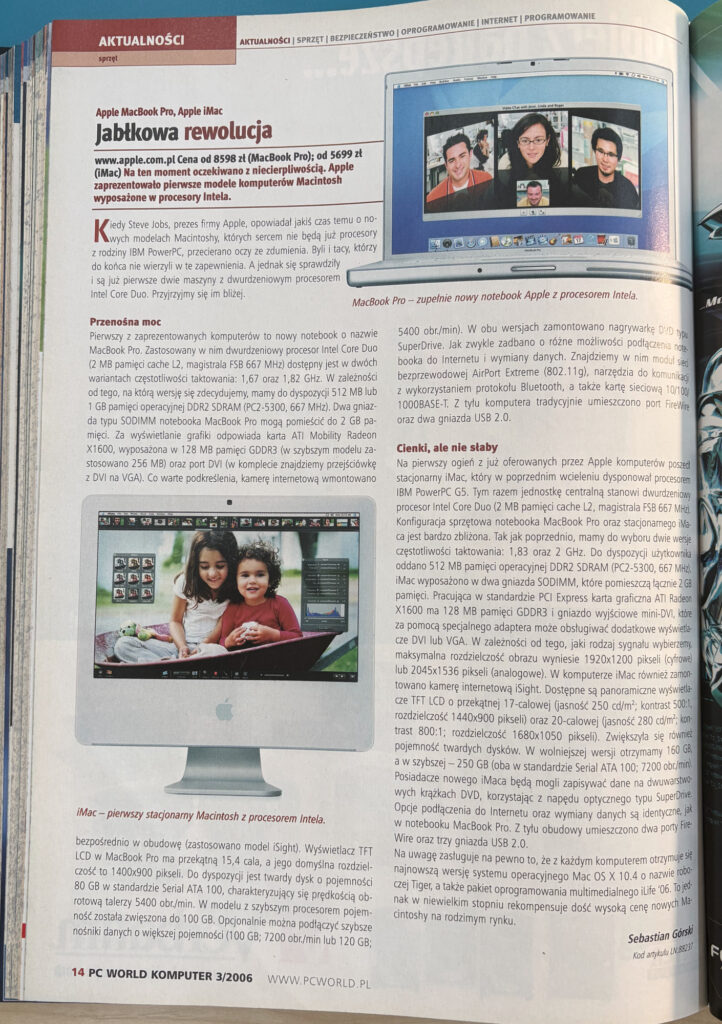

W trzecim numerze PC World Komputera odnajdujemy informację o premierze komputerów Apple z procesorami Intel, konkretnie Intel Core Duo. Było to o tyle duże wydarzenie, że była to już kolejna przesiadka komputerów Apple na nową platformę sprzętową. Przypomnijmy, że w latach 84-95 komputery Apple działały na procesorach Motorola serii 68K. Potem w roku 94 zaczęła się udana przesiadka na procesory IBM PowerPC (i jednocześnie zmiana System 7 na OS X). Z kolei w roku 2006 miała miejsce udana przesiadka z PowerPC na kolejne generacje procesorów Intela. A w roku 2020 rozpoczęła się udana, nie jest to chyba niespodzianką, przesiadka na Apple Silicon.

Zwróćmy uwagę, że w każdej z tych trzech dość fundamentalnych zmian mieliśmy jakąś formę kompatybilności wstecznej, utrzymywanej przez parę lat. PowerPC potrafił emulować procesory Motorola 68K. Natomiast później oprogramowanie o nazwie Rosetta pozwalało na dynamiczną translację oprogramowania z PowerPC na Intela, a potem podobnie z Intela na Apple Silicon. Jest to duże osiągnięcie i naprawdę niewiele firm odważyłoby się na tak fundamentalne zmiany, choć być może za trzecim razem nie było to już takim ryzykiem jak za pierwszym czy drugim.

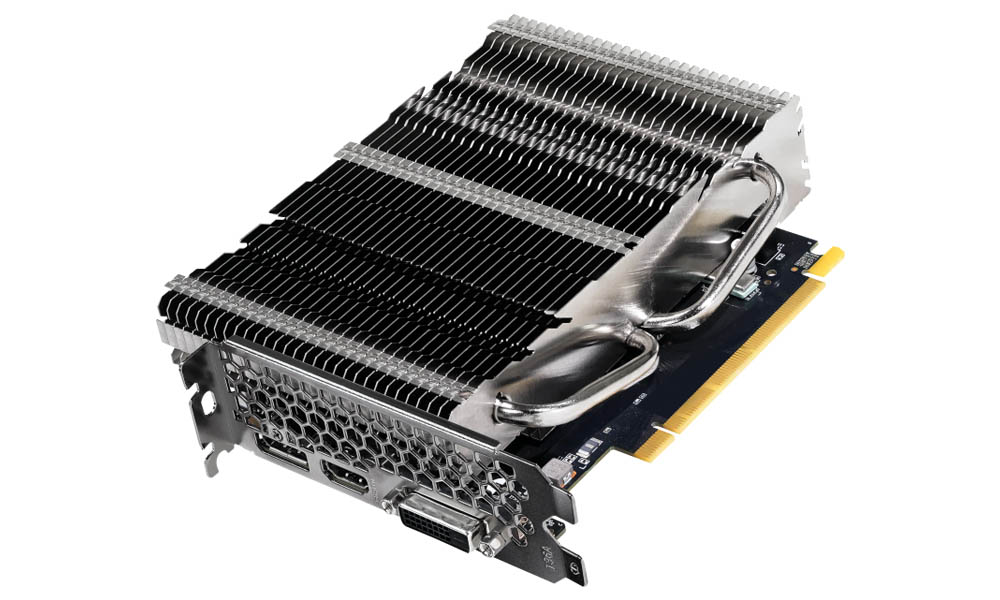

W tym samym numerze PC World Komputera odnajdujemy artykuł o kartach graficznych chłodzonych pasywnie, czyli takich, które nie są wyposażone we własne wiatraki. Byłem przekonany, że taki sprzęt kończył się mniej więcej właśnie około roku 2006, bo wszystkie późniejsze konstrukcje żarły dużo więcej prądu i oddawały dużo więcej ciepła. Wydawało mi się, że nie ma mowy, żeby wyprodukować akcelerator graficzny bez własnych wiatraków.

Okazuje się, że byłem w błędzie – nawet dzisiaj, w roku 2026, daje się kupić karty chłodzone pasywnie z układem NVidia RTX 3050. No, oczywiście taka karta jest z każdej strony owinięta żeberkami radiatorów, ma wewnątrz ileś heatpipe’ów, czyli ciepłowodów, tym niemniej to działa. Wymagana jest, ma się rozumieć, dobrze wentylowana buda, albo komputer, który w ogóle nie ma obudowy, tylko jest na przykład rozłożony na biurku.

Zakończenie

I to by było tyle na dzisiaj. Drugi odcinek jest krótszy niż pierwszy, tematów wybrałem nieco mniej, ale jak zwykle do audycji trafiły te ciekawe, które w jakiś sposób rezonują do dzisiaj. Będę bardzo wdzięczny za maile z waszymi opiniami, adres e-mail: tomasz.zielinski@gmail.com

Wkrótce na blogu pojawi się pełna transkrypcja razem z ilustracjami, tam również będzie można dodawać komentarze. Tymczasem do usłyszenia za miesiąc w odcinku trzecim!

O autorze: zawodowy programista od 2003 roku, pasjonat bezpieczeństwa informatycznego. Rozwijał systemy finansowe dla NBP, tworzył i weryfikował zabezpieczenia bankowych aplikacji mobilnych, brał udział w pracach nad grą Angry Birds i wyszukiwarką internetową Microsoft Bing.

14 odpowiedzi na “Drugi odcinek retro-podcastu – wciąż bez nazwy”

Dla osób, które chcą podcastu w aplikacji – ten feed RSS działa super

https://informatykzakladowy.pl/category/podcast/feed/

A czemu wyleciał PC Kurier?

Kiepski stosunek sygnału do szumu – przejrzałem 5-6 numerów i łącznie były tam dwa teksty kategorii „być może”. Enter ma więcej mięsa.

Fajna sprawa z analogowymy tunerami była taka, że można było dekodować płatne programy typu HBO i Canal+. Działało to całkiem dobrze

Pamiętam te czasy…. Niesamowita dynamika jeśli chodzi o przyrost mocy komputerów wraz z każdym kolejnym procesorem. Sam rynek procesorów to też była inna rzeczywistość. Był Intel, ale był tez bodajże Cyrix. AMD dołączyło chyba trochę później. Nie każdy soft był kompatybilny z każdym procesorem.

Rozpoczynała się też era podkręcania… Pamiętam fajne projekty zanurzenia całej płyty głównej w kuwecie z olejem technicznym celem chłodzenia procesora.

Podcast tak jak poprzedni świetnie się czytało (tak, po prostu bardziej preferuję formę pisaną niż słuchaną).

Naprawdę fajnie wrócić i zweryfikować czy dane technologie pokryły się z zapowiedziami. Jakiś czas temu, bodajże w PC Formacie z okolic 2012 pisali że już niedługo w sklepach będą dostępne dyski HDD ponad 10 TB przeznaczone do typowych stacjonarków, dane będziemy nagrywać na 6 TB płytach HVD, a laptopy zwane Plantbookami do działania będą wymagały jedynie baterii zamoczonej w szklance wody. Ile się z tego sprawdziło? Łatwo wywnioskować 😉

A co do nazwy podcastu to proponuję o taką nazwę: „Podcastowy Przegląd Prasy i Nie tylko” – w skrócie PPPiN

Ewentualnie tę serię podcastów można nazwać jako rozwinięcie oryginalnego pomysłu, czyli:

„Podcast Informatyka Zakładowego Zawsze Aktualny (PIZZA)”

„widoczek podczas zbierania materiałów do podcastu”

pozdrowienia z Wrocławia – piękny widok (wiemy na co i skąd 😉

i dzięki za mnóstwo wspomnień – zaczynałem w latach 80. na C64, miałem trochę kontaktów z wrocławskim środowiskiem commodorowców, u znajomych P. na Zielińskiego dotknąłem pierwszej Amigi, sam nigdy nie wszedłem na poważnie w programowanie, ale – tu się pochwalę – na C64 napisałem całkiem poważny automat perkusyjny z silnikiem w kodzie maszynowym, czytałem Bajtka (rzeczywiście, jak była mowa w pierwszym odcinku, rozjechał się mocno), później bardzo sobie ceniłem PC Magazine z felietonami Lema. no i przeszedłem te wszystkie rewolucje, o których w większości zapomniałem 😀 (ktoś tu przypomniał Cyriksa)

Chyba wymagana jest drobna korekta. VideoCD to standard MPEG-1.

Standard MPEG-2 wykorzystano na DVD-Video: rozdzielczość 720×576 u nas (PAL) przy 25 klatkach na sekundę z przeplotem (dlatego postrzegana płynność to 50 fps) oraz 720×480 w USA (NTSC) przy 29.97 klatkach na sekundę z przeplotem (postrzegane 59.94 fps).

Nie mogę znaleźć skanu tego numeru w internecie, dlatego ciężko stwierdzić czy powiązanie VideoCD z MPEG-2 to błąd interpretacji artukułu czy może sam autor artykułu z 1996 roku się pomylił.

Kontekst historyczny też tego nie wyjaśnia. DVD wynaleziono w 1995 roku, ale premiera to trochę później, 1 listopada 1996 w Japonii. Z drugiej strony, premiera VCD to 1993. Jaki był sens testować karty MPEG-1 trzy lata po premierze formatu? Raczej chodziło tutaj o MPEG-2. Skan lub zdjęcie tego artykułu wszystko wyjaśni.

Ha. Pomyłka jest w całości moja – może w głowie nazwa standardu wideo skleiła mi się z kodowaniem audio MPEG-1 Layer II? Nie wiem, trzeba będzie wrzucić do kolejnego odcinka erratę. Mowa w każdym razie o kartach do dekodowania MPEG-1, DVD było wówczas pieśnią przyszłości.

Oto skan tekstu:

kurde nie mogę się doczekać pierwszych przenośnych „empetrójek” 😀

Świetny artykuł, (bo w takiej wersji zapoznaję się z nim) tak samo jak cz.1. Czekam z niecierpliwością na część 3! 🙂

Super się czytało 🙂

Może to jakaś nostalgia, ale fajnie się słucha o tych czasach. Pewnie dla młodszych nie jest to jakieś fascynujące, ale fajnie sobie przypomnieć. Może się mylę, ale ten wyścig był jakiś ciekawszy niż teraz gigakorporacji