Prezentuję pierwszy odcinek mojego retro-podcastu, w którym robię przegląd prasy komputerowej sprzed 20, 25 i 30 lat. Mógłbym wstawić tu mema pt. „byłem tam, Gandalfie, trzy tysiące lat temu”, ale ja faktycznie tam byłem. Od przełomu lat ’80 i ’90, jako posiadacz Commodore 64, oraz późniejszy posiadacz 486 DX, z fascynacją obserwowałem rozwój popularności komputerów osobistych w Polsce.

Także w internecie (wtedy pisanym z wielkiej litery) zameldowałem się dość wcześnie, około roku 1995. W roku 1997 założyłem sieć blokową podpiętą do internetu przez rozliczane ryczałtowo łącze ISDN, kilka lat później eksperymentowałem z łączeniem laptopa z siecią komórkową i usługą GPRS (za pomocą Nokii, a jakże). Mam o tym tysiąc i jedną opowieść.

Przygotowując podcast, przez wiele godzin wertowałem w Bibliotece Uniwersyteckiej egzemplarze CHIP-a, PC World Komputera, PC Kuriera, Bajtka – z lutego 1996, 2001 oraz 2006. Co ciekawego w nich znalazłem? Historię formatu graficznego PNG. Dzieje nagrywarek CD i DVD rozciągnięte na półtorej dekady. Podkręcanie procesorów Duron… ołówkiem. Prognozy i przewidywania, jak rozwinie się standard Bluetooth, e-papier i biometria. Oraz wiele, wiele innych zdarzeń, faktów, opinii.

Uwagi edytorskie: wersję audio podcastu można znaleźć na YouTube, dostępny jest też plik MP3. Publikacja na platformach podcastowych pojawi się, gdy wreszcie wymyślę nazwę. Niżej znajdziesz transkrypcję całego godzinnego monologu (zapis tekstowy został nieznacznie zmodyfikowany aby lepiej się go czytało). Klikaj obrazki aby je powiększyć.

Wstęp

Dzień dobry!

Nazywam się Tomek Zieliński, jestem autorem bloga Informatyk Zakładowy, a dzisiaj witam w moim nowym projekciku historycznym. Nagrywam te słowa w lutym 2026 i jest to pierwszy odcinek cyklu, który nie ma jeszcze swojej nazwy. Muszę ją dopiero wymyślić. O czym będzie mowa?

Planuję robić cykliczny przegląd starej prasy komputerowej i opowiadać o tym, jak ewoluowały domowe pecety – zarówno sprzęt, jak i oprogramowanie. Umownym początkiem okresu, który mnie interesuje jest rok 1995, czyli rok premiery systemu Windows 95. Oczywiście 8- czy 16-bitowe komputery, które mieliśmy na przełomie lat 80-tych i 90-tych były również bardzo ciekawe, ale to jest jednak prehistoria i hobby dużo, dużo bardziej niszowe.

Gdyby kogoś posadzić przed komputerem z Windows 95 i Office 95, ten ktoś potrafiłby bez problemu poruszać się po systemie. Miałby klawiaturę, myszkę, na ekranie widziałby pasek zadań, menu start, no ale z drugiej strony taki ktoś nie rozpozna praktycznie żadnej wtyczki ani żadnego gniazdka w tym komputerze. Bo przecież nie ma jeszcze USB, a nieliczne urządzenia peryferyjne miały swoje typy gniazdek, wtyczek. Niektóre z nich, np. skanery, kupowało się wręcz z kartą rozszerzeń, którą trzeba było zainstalować wewnątrz komputera, aby móc mieć do czego podłączyć skaner. A taki np. napęd CD-ROM, gdy już ktoś się go dorobił, należało podłączyć do.. karty dźwiękowej, do właściwego spośród trzech prawie identycznych gniazdek.

Pomysł na ten cykl chodzi mi po głowie od dawna. Jestem pasjonatem świata IT i śledzę wszystko co związane z komputerami od dzieciaka. Na przełomie lat 80-tych i 90-tych dostałem Commodore’a 64, a w roku 1994 rodzice kupili mi pierwszego peceta, na którym grałem, próbowałem programować, próbowałem tworzyć grafikę. Słowem, chłonąłem wiedzę jak gąbka, próbowałem robić wszystko.

Okazało się, że tej wiedzy troszkę jednak zebrałem, bo już w klasie maturalnej, czyli w roku 1997 miałem jej tyle, że zacząłem pisać do lokalnego dodatku gazety „Słowo Polskie” o nazwie „Słowo o komputerach”. Potem, już w czasie studiów, w roku 1999, zacząłem współpracę z magazynem komputerowym CHIP, który miał wtedy redakcję we Wrocławiu. Byłem współpracownikiem CHIP-Labu, testowałem sprzęt, pisałem o nim artykuły, no i robiłem to przez ponad 3 lata, do roku 2003.

Tak więc, idea stojąca za tym cyklem, który wciąż nie ma nazwy, jest następująca. Co miesiąc będę robił przegląd prasy sprzed 20, 25 i 30 lat. W tym odcinku będzie to więc luty 1996, luty 2001 oraz luty 2006.

Przejrzałem miesięczniki CHIP, PC World Komputer, Bajtek. Zajrzałem do dwutygodnika PC Kurier. Musiałem pójść do biblioteki uniwersyteckiej, zapisać się do czytelni, zamawiać roczniki tych czasopism, które oprawione w tomy przywożono mi wózkiem na kółkach. I wynotowałem sobie stamtąd zestaw interesujących tekstów, o których dzisiaj chciałbym opowiedzieć.

Zaczynajmy zatem nasz przegląd prasy.

Mamy luty 1996

Minimalna płaca wynosi 325 zł. Średnia płaca wynosi 873 zł.

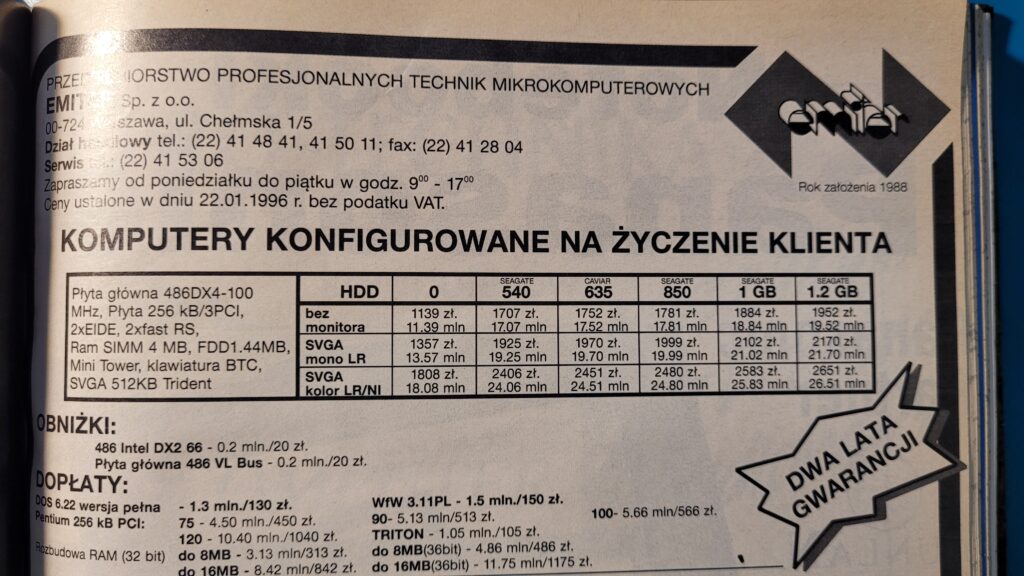

Mówię o tym, bo dopiero przeglądając cenniki sprzętu i oprogramowania zdałem sobie sprawę, jak drogie były wtedy komputery. Ile trzeba było wydać, żeby móc pozwolić sobie na peceta. W PC-Kurierze numer 3/1996 znalazłem cennik, jeden z wielu, Przedsiębiorstwa Profesjonalnych Technik Mikrokomputerowych Emiter z Warszawy z ulicy Chełmskiej. Pozdrawiam, jeśli ktoś pamięta tą firmę. Była to jedna z tysięcy podobnych jej firm komputerowych, które składały pecety na zamówienie.

Największą ramkę stanowi oferta typowego komputera, wtedy najpopularniejszego, który trafiał do typowego odbiorcy. Płyta główna z procesorem 486DX4 100 MHz, obudowa mini tower, z klawiaturą, z kartą graficzną SVGA Trident 512 KB. Ramka pokazuje ceny z dyskami twardymi o różnych pojemnościach i z monitorem – do wyboru – albo SVGA czarno-białym albo kolorowym.

Ile trzeba było wydać na taką konfigurację? Weźmy najtańszą jaka jest, czyli dysk 540 MB i monitor czarno-biały. Na taki komputer trzeba było wydać 1925 złotych, czyli ponad dwie średnie pensje. Jeśli popatrzymy na taki przyzwoity sprzęt, z troszkę większym dyskiem 850 MB i z kolorowym monitorem to za taką konfigurację musimy zapłacić już 2480 złotych. To oznacza, że to są prawie trzy średnie pensje, żeby kupić typowego peceta, który tak naprawdę w ciągu dwóch, trzech lat wymagałby poważnej modernizacji. Wiemy, że gdy dzisiaj średnia pensja wynosi około 9000 złotych, to naprawdę porządnego PC-ta możemy kupić za połowę tej kwoty.

Oczywiście cennik, o którym mówię, ma również warianty z dopłatami. Gdybyśmy chcieli nie 486 DX, tylko Pentium 120 MHz i zamiast proponowanych 4 MB RAM-u rozbudowali sobie zestaw do 16 MB, to musielibyśmy do tej wcześniejszej kwoty dopłacić jeszcze 1800 złotych, czyli następne dwie pensje. To oznacza, że taki naprawdę wypasiony pecet kosztował 5 średnich polskich pensji. Przyznacie sami, że jest to troszkę przerażające. Dzisiaj za jedną średnią pensję można kupić peceta, który jest naprawdę na wypasie.

Oczywiście cały czas mówię tutaj o kwotach pensji brutto. To – jak wiadomo – nie jest kwota, którą pracownik dostaje na rękę, to nie jest kwota rozporządzalna – ale pozwala nam porównywać ceny relatywnie do zarobków.

W 1996 roku wszystkie gazety odnotowały premierę Windowsa 95 w wersji polskiej oraz Office’a 95 w wersji polskiej. Jeśli chodzi o Office’a, to była to pierwsza wersja z wszystkimi spolonizowanymi aplikacjami. Natomiast Windows 95 PL wyszedł w roku 1996, bo wtedy standardem było, że narodowe wersje systemu Windows – szczególnie te na mniej istotne rynki – były wydawane z kilkumiesięcznym opóźnieniem.

Ile kosztował Office? Gdy spojrzymy na inne ogłoszenie, np. przykładowo ceną firmy PC Biker, również z Warszawy, to widzimy, że Office standardowy dla Windows 95 kosztuje 1010 złotych. Ponownie jest to więcej niż średnia pensja, więcej niż 3 minimalne pensje. Gdy popatrzymy na dzisiejsze ceny, które również nieznacznie przekraczają 1000 złotych, no to tak naprawdę Office w wersji domowej i dla małych firm kosztuje mniej niż ćwierć minimalnej pensji. Wtedy ponad 3 minimalne pensje.

Więc widzimy naprawdę dramatyczną różnicę. Nie pamięta się o tym. Ja wiem, że komputery były drogie. Wiem, że dla moich rodziców wielkim wyrzeczeniem było kupienie PC-ta. Mam nadzieję, mamo i tato, że opłaciło się – ja uważam, że tak. Ale w porównaniu do dzisiejszych zarobków i dzisiejszych kosztów elektroniki, no to bycie fanem PC-tów w latach 90-tych było czymś naprawdę zupełnie innym.

Przejdźmy do lektury CHIP-a z lutego 1996. We wstępniaku redaktor naczelny Marek Zimnak i redaktor Adam Chabiński prowadzą następujący dialog, przeczytam tutaj fragment.

– I nie jest pan przerażony?

– Przerażony czym, przepraszam?

– Artykułem o tendencjach w sprzęcie. Kabel przesyłający 12 milionów bitów na sekundę. Napęd CD-ROM-ów z możliwością wielokrotnego zapisywania krążka. Jednogigabajtowe dyskietki i wiszące na ścianie ciekłokrystaliczne monitory o średnicy 22 cali i poborze mocy 15 W. To ma się podobno stać w tym roku naszym chlebem powszednim.

Gdy policzymy sobie jak szybko przesyłał dane ten wspomniany kabel, 12 milionów bitów na sekundę to około 1,5 MB na sekundę. Dzisiejsze dyski NVMe PCIe 5 generacji przesyłają nie 1,5 MB tylko prawie 15 tysięcy megabajtów. Czyli lekko licząc 10 tysięcy razy szybciej. Oczywiście ekrany ciekłokrystaliczne mają dużo więcej niż 22 cale. Jeśli chodzi o CD-ROM-y to mało kto pamięta jeszcze jak się je zapisuje. Mało kto ma w swoim komputerze nagrywarkę do płyt.

W spisie treści znalazłem artykuł „Umarł GIF, niech żyje PNG”. Jest artykuł opisujący, skąd wziął się format PNG a tak naprawdę jak wyglądała historia formatu GIF. Format GIF był użyty w pierwszych przeglądarkach internetowych ponieważ te obrazki, które umieszczano wtedy na stronach WWW, musiały być małe, ładować się szybko – no i GIF był tutaj idealny.

Zapewniał całkiem niezłą kompresję pozwalał używać do 256 kolorów z palety 24 bitowej czyli 16 milionów barw. Był bezstratny. Obsługiwał podstawową formę przezroczystości. Bardzo istotne we wczesnym internecie było to, że pokazywał zawartość progresywnie podczas ładowania – czyli zanim jeszcze obrazek się załadował, widzieliśmy stopniowe przybliżenia, stopniowe ładowanie tego obrazka z coraz większą liczbą szczegółów. To pozwalało nam na przykład kliknąć jakiś link, zanim jeszcze zobaczyliśmy całą zawartość bieżącej strony, która mogła ładować się dłużej niż byśmy chcieli.

Z formatem GIF, który zaczął zdobywać popularność właśnie w latach 1994-1995 był taki problem, że był to format objęty kilkoma patentami. Firmy Unisys i CompuServe dysponowały jakąś tam pulą patentów których nie egzekwowały przez długi czas. Natomiast gdy okazało się, że internet zyskuje popularność, że strony WWW zyskują popularność i format GIF jest tam powszechny, no to wtedy te firmy zaczęły zwracać się do producentów oprogramowania graficznego z żądaniem wnoszenia opłat licencyjnych.

Wiele osób przestraszyło się, że będą to opłaty nie tylko od producentów programów graficznych, ale także od użytkowników przeglądarek. I w związku z tym kilku badaczy rozpoczęło pracę nad formatem PNG czyli alternatywą dla GIF-a, która będzie szybsza, lepsza i nie objęta płatnymi patentami. Tak też się stało, opracowano format, który był nawet lepszy od pierwowzoru.

Format PNG również był bezstratny, oferował pełną paletę 24-bitową jednocześnie oraz kanał alfa z 256 stopniami przezroczystości. Miał lepszą kompresję. No i tak naprawdę z perspektywy czasu wiemy, że miał tylko jedną wadę. Pierwsza opublikowana wersja specyfikacji nie zawierała wariantu z animacjami. To oznacza, że można było używać PNG do szerokiej maści zastosowań, ale jeśli chcieliśmy wstawić jakiś animowany obrazeczek – jak ludzik z łopatą informujący, że prace nad daną witryną jeszcze trwają, albo jakieś animowane logo – to używaliśmy nadal GIF-a.

30 lat później nadal używamy formatu GIF. Oczywiście animowany PNG pojawił się rok albo dwa później, ale było już za późno. Biblioteki graficzne, które zostały włączone do przeglądarek, nie obsługiwały go jeszcze. I tak naprawdę wady GIF-a z perspektywy czasu stały się raczej cechą. Dziś wiemy, że to będą obrazki dość duże, niezbyt piękne, nie będą się płynnie animowały, paleta barw będzie ograniczona. Ale jeśli chodzi o memy to dodaje to smaczku czy kolorytu. W 1996 roku zapewne nikt nie spodziewałby się, że w roku 2026 GIF-y nadal będą miały się nieźle.

Przy czym używanie tego formatu nie wiąże się już dzisiaj z żadnymi opłatami licencyjnymi, ponieważ wszystkie patenty Unisys i CompuServe’a wygasły w roku 2004. No i od tamtego czasu można było używać GIF-ów czy też enkoderów GIF-a w dowolnym oprogramowaniu bez zmartwień, że trzeba będzie wnosić opłaty licencyjne.

Inny artykuł z CHIP-a. OS/2 po polsku, czyli niesławny system, który był produkowany przez autorską spółkę IBM i Microsoft, i nie skończyło się to dla IBM-a dobrze. Dziś wiemy, że tutaj wolniejsze tempo produkcji systemu OS/2 Warp w wersji trzeciej, wynikało z tego, że Microsoft po pierwsze musiał współpracować z IBM-em – zewnętrzną firmą, co zawsze jest mniej efektywne, niż praca nad jakimś softem w obrębie jednej firmy. Po drugie, gdy okazało się, że Windows 95 ma szansę naprawdę zawojować rynek, Microsoft przestał przykładać się do tej współpracy. Celowo opóźniano prace, nie nadawano im priorytetu, a jednocześnie Microsoft dbał o to, żeby jak najwięcej szumu na rynku robić zapowiedziami Windows 95, a nie OS/2 produkowanego razem z IBM-em.

W tym artykule zdziwiło mnie, że dostępny był OS-2 po polsku, bo całkowicie wyleciało mi to z głowy. W ogóle ten system miałem zainstalowany przez krótki czas, tylko po to, żeby zobaczyć jak wygląda. W tamtych czasach wymagał bardzo dużo pamięci, chyba działał na 4 MB ale 8 MB to było sensowne minimum, wymagał też lepszych procesorów niż Windows 95. W połączeniu z wszechobecnym piractwem DOS-a i Windows, pod którego w Polsce pisano praktycznie wszystkie programy, OS-2 nie miał szans i użytkownicy domowi czy firmowi całkowicie go zignorowali.

PC World Komputer numer 2/1996. Znaczącym tekstem jest artykuł o nagrywarkach CD, który zaczyna się od następujących słów: „powoli zbliżają się czasy, kiedy każdy komputer będzie wyposażony w czytnik CD-ROM. Już dziś istnieją firmy, które oferują takie zestawy jako standard. Czy chcemy czy nie, dyski kompaktowe stają się standardem, jeśli chodzi o nośnik dużej pojemności”.

To wszystko prawda. W drugiej połowie lat 90-tych, płyty CD stały się standardowym dodatkiem do magazynów komputerowych. Wynikało to z tego, że ich tłoczenie było tanie, był to koszt około złotówki za sztukę. Ale mieliśmy do czynienia z nośnikiem jedynie do odczytu. Gdyby ktoś chciał nagrać płytę CD, urządzenia takie już istniały, ale były niesamowicie drogie. To oczywiście oznaczało, że na giełdach komputerowych i w różnych firmach można było kupić usługę nagrywania. Czysta płyta kosztowała wtedy około 30 złotych – nieco poniżej 10% płacy minimalnej – natomiast razem z usługą nagrania kosztowało około 100 złotych.

Dodajmy, że na pierwszych nagrywarkach, jakie były dostępne, każde nagrywanie było przygodą, ponieważ ówczesne urządzenia wymagały stałej dostawy danych podczas nagrywania. To oznacza, że jeśli ktoś chciał nagrać dużą ilość małych plików i jego dysk twardy nie potrafił ich odczytać na czas i dostarczyć w wymaganym tempie do nagrywarki, wtedy następował tzw. buffer underrun.

Nagrywarka, która nie dostała danych na czas, przerywała nagrywanie i płyta była do wyrzucenia, ponieważ nie było żadnych mechanizmów, które pozwalałyby wznowić takie nagranie. To oznaczało też, że ówczesne programy do nagrywania miały opcję testu – robiły wszystko tak, jakby nagranie miało miejsce, ale laser miał znacznie mniejszą moc i tak naprawdę niczego w płycie CDR nie wypalał – natomiast pozwalało to sprawdzić, czy rzeczywiście takie nagranie może się udać. Jeśli tak, no to w kolejnym przebiegu następowało rzeczywiste wypalanie danych.

Przy nagrywaniu z prędkością x1, czyli około 150 KB na sekundę, zapełnienie całej płyty trwało godzinę. Jeśli najpierw robiliśmy test, a potem nagranie – dwie godziny z głowy. Oczywiście w przyszłości częstą praktyką było przygotowanie zawczasu pliku z obrazem płyty. Taki plik był po prostu przenoszony na nagrywalny nośnik. Tyle tylko, że w roku 1996, typowy dysk twardy w komputerach domowych był mniejszy od pojemności płyty CD. To sprawiało oczywiście, że nie było mowy o tym, aby dało się przygotować taki obraz zawczasu.

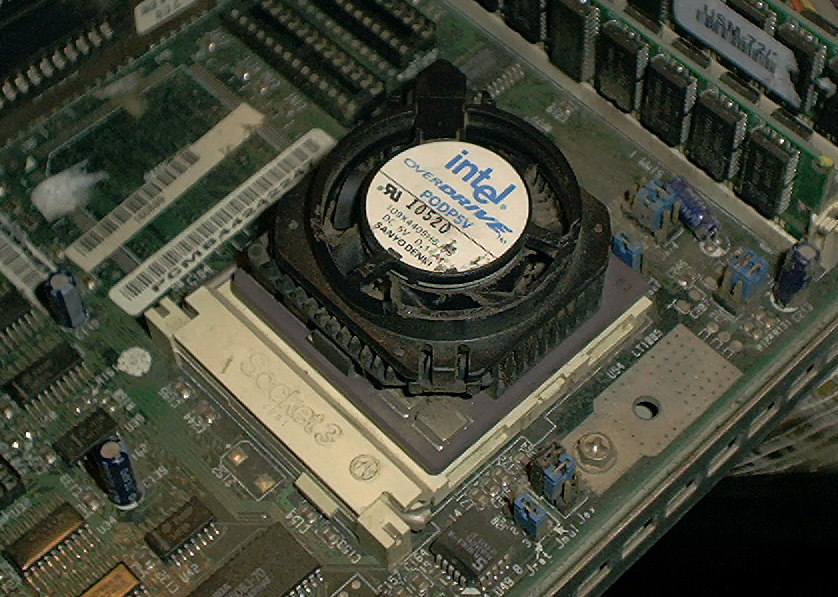

Kolejny artykuł z PC World Komputera o upgrade’owaniu komputerów 486 do nowszych procesorów, ale bez wymiany płyty głównej. Mowa o układach Intel Pentium Overdrive albo DX4 Overdrive. W jaki sposób realizowano przyspieszenie obliczeń? Na dwa sposoby.

Jeśli mowa o DX2 albo DX4 Overdrive, to był to nowszy procesor, który miał zwiększoną częstotliwość. No, ponieważ płyta główna pracowała albo z częstotliwością 25, albo 33 MHz, procesor dostawał mnożnik razy 2, albo razy 3, albo razy 4, co oznaczało, że rzeczywista prędkość taktowania procesora zwiększała się do wartości między 50 a 100 MHz. Jednocześnie w razie potrzeby stosowana była podstawka pod procesor, która dopasowywała napięcie ze starszego standardu 5 V, na nowszy 3,3 V. W przypadku Pentium Overdrive dodatkową zaletą była nowsza architektura procesora.

Taka oferta pozwalała zmodernizować domowy komputer za cenę niższą niż wymiana procesora i płyty głównej, nierzadko również pamięci. Tutaj płaciliśmy jedynie za nowy procesor, wraz z ewentualnie dodatkowymi układami, które były podłączane do istniejącej płyty głównej.

Czy to się opłacało? I tak, i nie. Zależało to oczywiście od wydajności komputera bazowego. Jeśli mieliśmy wolny 486SX, to zestawem Pentium Overdrive mogliśmy nawet podwoić wydajność komputera. Natomiast jeśli mieliśmy już przyzwoitego 486DX2, wtedy taki Pentium Overdrive dawał nam jedynie 30-40% dodatkowej mocy, no i to niekoniecznie się opłacało. Bo trzeba pamiętać, że wzrost surowej mocy samego procesora nie przyspieszał nam pamięci, nie przyspieszał nam komunikacji z dyskiem twardym. A starsze komputery miały te wszystkie akcesoria wolniejsze niż nowe pecety wykorzystujące nowsze standardy. Była to ciekawostka, która dość szybko znikła z rynku, ale narobiła użytkownikom komputerów 486 smaka na to, żeby jednak w jakiś sposób wydajność swoich pecetów zwiększyć.

Zajrzałem jeszcze do Bajtka nr 2/1996 i tak naprawdę nie mam tutaj za dużo do opowiedzenia. Nie znalazłem tam żadnego materiału godnego uwagi. Bajtek, który na przełomie lat ‘80 i ‘90 był dla wielu pasjonatów podstawowym źródłem informacji, w 1996 roku reprezentował już tylko cień tej popularności i klasy sprzed dekady. Ostatecznie przestał wychodzić w drugiej połowie 1996. Miał przestarzały layout, zawierał wyłącznie recenzje oprogramowania – najwyraźniej redakcja nie miała kontaktu z dystrybutorami sprzętu, a przynajmniej nie na tyle regularne, żeby coś znalazło się w każdym numerze.

Mimo, że było już naprawdę późno, w roku 1996 pecety były wszechobecne, w Bajtku ciągle jeszcze publikowano teksty o Amidze. No a redakcja próbowała różnych dziwnych rzeczy, na przykład dział o muzyce elektronicznej, który z komputerami de facto miał niewiele wspólnego. Tak więc w Bajtku z lutego 1996 nie znalazłem niestety niczego godnego odnotowania.

Przeskakujemy 5 lat do przodu.

Mamy luty 2001 roku

Pensja minimalna wynosi 760 złotych, średnia pensja wynosi 2061 złotych.

Jest to złota era magazynów komputerowych w Polsce. CHIP numer 2/2001 roku ma aż 210 stron. Gdy przyniesiono mi do czytelni biblioteki uniwersyteckiej cały rocznik, były to 4 grubaśne, ciężkie tomy po ponad 600 stron każdy. Jest to imponujące i naprawdę robi wrażenie, gdy przegląda się te magazyny po 25 latach.

Moją uwagę zwrócił test napędów optycznych typu combo, czyli nagrywarka CD-RW i odtwarzacz DVD. Znaczącą cechą tych napędów było to, że potrafiły wznawiać nagrywanie w przypadku wystąpienia problemu typu buffer underrun. Gdy z jakiegoś powodu nagrywarka nie dostała w porę wymaganego pakietu danych, potrafiła przerwać nagrywanie na granicy sektora, a potem wznowić je, gdy bufor danych do nagrywania został uzupełniony.

To oznaczało, że po pierwsze nie traciliśmy nośników (które na szczęście były już wtedy dużo tańsze), ale nie traciliśmy też czasu, bo płyty za każdym razem nagrywały się jak należy. Dodajmy, że nagrywarki pracowały wtedy z prędkością x10 albo x12, nagranie całego nośnika nie oznaczało już godzinę, tylko jakieś 4 do 6 minut. Mieliśmy też rozróżnienie na nośniki CD-R i CD-RW, do jednokrotnego, albo wielokrotnego nagrywania.

No i rzeczy trochę skomplikowały się, gdy przyszło do nagrywania płyt DVD. Bo tam mieliśmy do czynienia z dwoma konkurencyjnymi standardami, DVD+R i DVD-R. Potem były jeszcze osobne fikołki z formatami do wielokrotnego zapisu. No a tak naprawdę, gdy pojawiły się na rynku napędy potrafiące zrobić wszystko za wszystkim, czyli odczytujące wszystkie standardy, nagrywające wszystkie standardy – to nie miało to już większego znaczenia, bo przestaliśmy po prostu nagrywać płyty CD, płyty DVD. Nie było to nam już potrzebne.

Innym ciekawym artykułem z tego numeru CHIP-a jest tekst o podkręcaniu procesorów. Dziś jest to temat niszowy, bo tak naprawdę zyski wydajności, jakie możemy osiągnąć na współczesnych procesorach, są bardzo niewielkie. We wczesnych latach 2000 było jednak inaczej. Na przykład popularny procesor Celeron 300A, chodzący nominalnie na 300 MHz, dało się często podkręcić nawet do 450 MHz, co oznaczało, że dostawaliśmy 50% więcej mocy. Dzisiaj nie ma już mowy o tym, aby było to możliwe. Procesory są tak wyżyłowane, że takich rezerw po prostu już nie ma.

Dodajmy, że temat podkręcania nie był łatwy i zależał mocno od generacji sprzętu, od tego w jaki sposób konstruowano płyty główne, w jaki sposób konfigurowane były procesory i pamięci. Gdy podkręcanie raczkowało, modyfikowaliśmy częstotliwość taktowania całej szyny systemowej. Jeśli przekroczyliśmy próg tolerancji jakiegoś urządzenia, na przykład dysku, no to komputer przestawał działać.

Po jakimś czasie oddzielono częstotliwość taktowania pamięci RAM od głównej szyny procesora. Pojawiły się mnożniki procesorów. Można było przestawiać mnożnik zworkami i sprawdzić, czy procesor puszczony szybciej, niż nominalnie, nadal uruchamia się. To często oznaczało, że trzeba było podać troszkę wyższe napięcie na nóżkach procesora, czasem również pamięci. To z kolei oznaczało, że trzeba było zapewnić lepsze chłodzenie. Mogli to robić ci, którzy potrafili na przykład zresetować zawartość BIOSu, jeśli komputer przestał się uruchamiać.

Słowem – była to wiedza tajemna, której trzeba było naprawdę poświęcić trochę czasu i energii. Nie wystarczyło, że podkręcony komputer raz się uruchomił. Trzeba było jeszcze wiedzieć, w jaki sposób go wygrzać i w jaki sposób przetestować, sprawdzić, czy rzeczywiście mamy do czynienia ze stabilną pracą. Skracając tą historię – jeśli ktoś nie miał pieniędzy, ale miał czas, to mógł się bawić w podkręcanie.

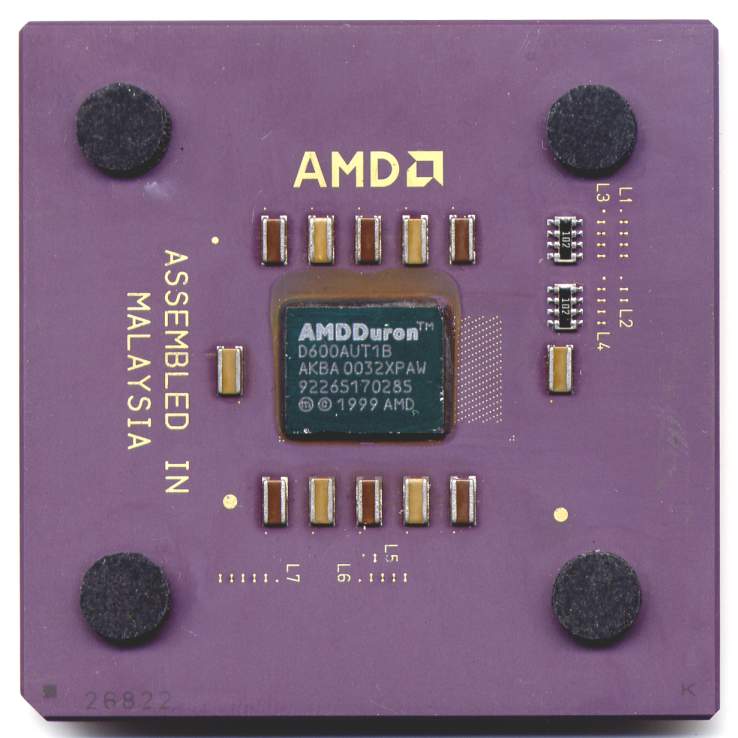

W procesorach z rodziny Duron producent blokował mnożniki. To oznaczało, że określał raz na zawsze, który egzemplarz będzie działał z jaką częstotliwością – stosownie do tego, jaką decyzję podjęto podczas produkcji i konfekcjonowania. Taki kawałek krzemu był sprzedawany po różnej cenie nawet, jeśli pochodził z tego samego wafla krzemowego, jeśli mieliśmy do czynienia z identyczną konstrukcją, tylko taktowaną różną częstotliwością zegara.

To oznacza, że można było próbować podkręcić swój procesor, jeśli tylko potrafiliśmy zmienić tą częstotliwość, którą założył producent. W procesorach Duron konfiguracja określona przez producenta była zdefiniowana w bardzo charakterystyczny sposób. Na obudowę procesora były wyprowadzone metalowe mostki. Wyglądały jak małe druciki wtopione w ceramikę. Producent w procesie produkcji przecinał laserowo te mostki w określonej kombinacji, która definiowała napięcie, jakim zasilany był procesor, oraz częstotliwość z jaką był taktowany.

I teraz charakterystyczne było to, że te mostki nie były niczym zabezpieczone. Można było wziąć zwykły ołówek, taki jaki mamy w piórniku, i zamalować przecięty mostek. Można było też wziąć skalpel i przeciąć mostek, który przez producenta był pozostawiony w całości. I te dwie możliwości sprawiały, że każdy chętny mógł spróbować zmienić napięcie i częstotliwość taktowania swojego procesora. Jeśli taka operacja się udała, mieliśmy przyrost wydajności za darmo. Gdy się nie udało, gdy dany egzemplarz procesora nie chciał pracować z wyższą częstotliwościa, bez problemu mogliśmy wrócić do poprzedniej konfiguracji, to znaczy zmazać część mostków, zamalować ołówkiem te, które były tam pierwotnie i procesor znów działał.

Innym ciekawym tekstem z tego numeru są wyniki plebiscytu na produkt roku 2000 według głosów przesłanych przez czytelników. Jeśli chodzi o ten tekst, to moją uwagę zwróciło nie tyle to, jakie marki, jakie produkty wygrały, ale to, że główną nagrodą w plebiscycie na produkt roku rozlosowaną między czytelników, był samochód Toyota Yaris. To daje pewne pojęcie, jakie budżety marketingowe miały firmy i czasopisma w tamtym okresie. Nie ma w tej chwili chyba żadnego konkursu czy plebiscytu w gazecie, który miałby tak drogą nagrodę. Oprócz samochodu nagrodami pocieszenia były: kupon wart 3000 zł, wycieczka zagraniczna dla dwóch osób, palmtopy, telefony komórkowe, więc widać, że było to wydarzenie naprawdę na wypasie.

Jeśli chodzi o produkty, które zwyciężyły w tym plebiscycie, to ciekawostką jest numer jeden w kategorii karty graficzne, czyli Creative 3D Blaster GeForce 2 GTS Ultra. Niedługo później firma Creative zrezygnowała z produkcji kart graficznych, ale w tamtych czasach, w opinii użytkowników, był to najlepszy produkt roku 2000. Na kartę graficzną Creativa zagłosowało 42% czytelników.

Charakterystyczne było to, że wszystkie trzy miejsca w plebiscycie na najlepszy monitor to były 17-calowe monitory CRT, czyli klasyczne „bańkowe”. Oferowały rozdzielczość 1600×1200 pikseli. Zwycięzca miał bardzo wysoką częstotliwość odświeżania 160 Hz. Typowy monitor, który mieliśmy w domach, miał w tamtych czasach 14 albo 15 cali. Ten 17-calowy to była raczej topka i to było raczej marzenie, niż coś, co mogliśmy spotkać w normalnym domu.

Ja pamiętam, że miałem wtedy monitor 17-calowy, ale jakiś taki starszego typu, był wielki i ciężki, ważył ponad 20 kg i naprawdę potrzebowałem solidnego biurka, żeby się z tym biurkiem nie gibał w lewo i w prawo. Ciekawostka – w kategorii programy narzędziowe pierwsze miejsce zajmuje Windows Commander, czyli program, który potem, na skutek żądań Microsoftu, został przemianowany na Total Commander.

W newsach numeru lutowego znalazła się jeszcze wzmianka o Google Toolbarze, czyli dodatku do przeglądarki, który można było doinstalować do Internet Explorera i cieszyć się takimi funkcjami, jak na przykład szybkie wyszukiwanie wprost po wpisaniu hasła w toolbarze. Mogliśmy też spojrzeć, jaki ranking w Google ma aktualnie odwiedzana strona. Toolbary, czyli osobne paski do przeglądarek, szybko zdobyły popularność i każdy szanujący się producent adware’u, czyli programowania reklamowego, produkował swój własny pasek, który był częstokroć wpychany na pałę, przymusowo, bez pytania. To oznaczało, że jeśli ktoś nie wywalał tych toolbarów ręcznie, to mógł mieć ich 5 albo 10, i naprawdę komfort przeglądania Internetu, który i tak nie był zbyt duży, spadał jeszcze bardziej.

Magazyn PC World Komputer nr 2/2001. Bardzo interesujący jest wstępniak, który opisuje wdrożenie inteligentnego domu, który ma na wyposażeniu skaner linii papilarnych w drzwiach, który ma – przypominam, w 2001 roku – fotowoltaikę, ma terminal do zamawiania zakupów, smart piekarnik (przypominający trochę z opisu Thermomixa), inteligentną kosiarkę do trawy, komunikację tych wszystkich urządzeń przez sieć zasilającą (Wi-Fi przecież jeszcze nie było wtedy popularne), oprócz tego integrację urządzeń audio i wideo.

Człowiek zadaje sobie pytanie, jak to możliwe, skoro dzisiaj byłby problem, żeby to wszystko w sensownych pieniądzach złożyć i oprogramować za pomocą Home Assistanta albo jakiegoś innego systemu do inteligentnego domu. No i rozwiązaniem tej zagadki jest fakt, że był to eksperyment, finansowany przez prywatną firmę, i kosztował podobno aż 5 milionów franków. To oznaczało tak naprawdę, że zapewne każde z tych urządzeń, o których mowa, było prototypem przygotowanym specjalnie na potrzeby tego eksperymentu. Musiało minąć ćwierć wieku, żeby inteligentny dom dało się zbudować za troszkę bardziej sensowne pieniądze.

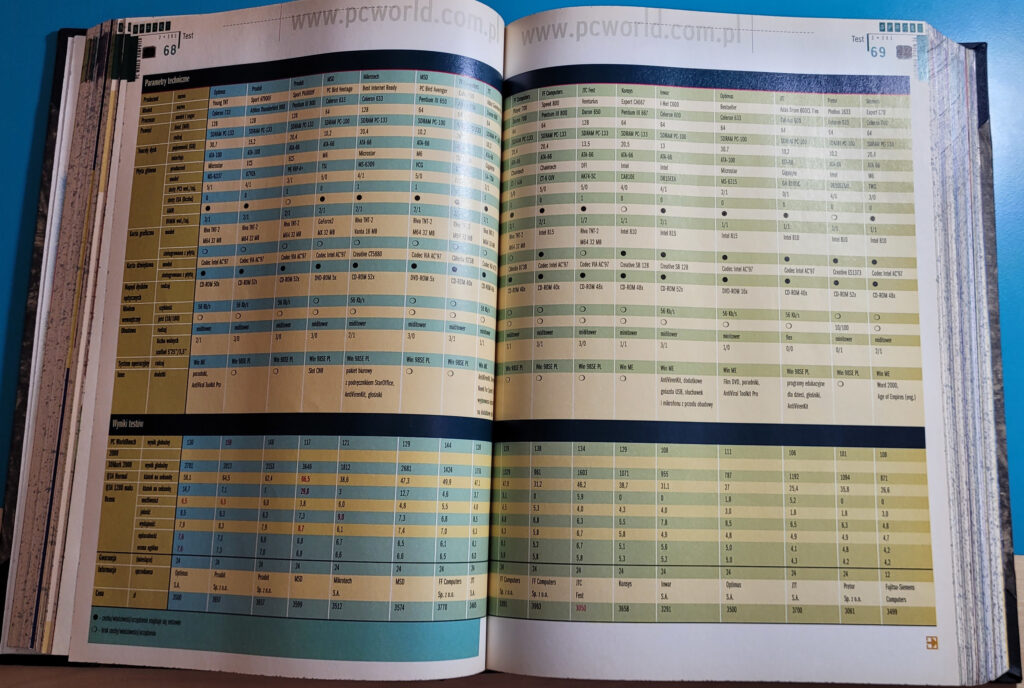

W tym numerze możemy zapoznać się z testem komputerów, czyli redakcyjnym przeglądem konfiguracji, które zostały dostarczone przez firmy zajmujące się składaniem PC-tów. Wiadomo, że komputery do takiego testu musiały być jakimś tam kompromisem między wydajnością a ceną, no i te konfiguracje, z którymi mieliśmy do czynienia, posiadały na pokładzie z reguły 64 lub 128 MB RAM-u, dysk twardy o pojemności minimum 10 GB (rekomendowane było 15 GB) i znacznie lepsza grafikę, niż 5 lat wcześniej. Bardzo często pojawiała się w tych zestawach Riva TNT, mająca aż 32 MB pamięci RAM. Procesor główny był taktowany zegarem między 600 a 900 MHz.

Charakterystyczne dla gazet z tamtego okresu: rozpiska tych konfiguracji zajmowała bite dwie strony – na rozkładówce mamy tabelkę, która ma kilkadziesiąt kolumn, kilkadziesiąt wierszy, no i te wszystkie informacje o testowanych konfiguracjach znajdują się w tej tabeli.

Co zwraca uwagę? Przetestowane konfiguracje kosztują – bez monitora – między 3500 a 4000 złotych. To nadal są dwie średnie pensje. Redakcja zwraca uwagę kupujących, aby sprawdzali, czy na komputerze znajduje się plomba producenta. Bo niektórzy producenci chronili się w ten sposób przed jakimiś modyfikacjami, które mogłyby komputer uszkodzić. Więc aby było wiadomo, czy sprzęt był otwierany przez użytkownika, na obudowie pojawiała się plomba. No ale to z kolei oznaczało, że jeśli ktoś nie chciał naruszyć takiej plomby, no to przez cały okres gwarancji nie mógł zmodernizować sobie swojej konfiguracji, nie mógł niczego dołożyć do środka.

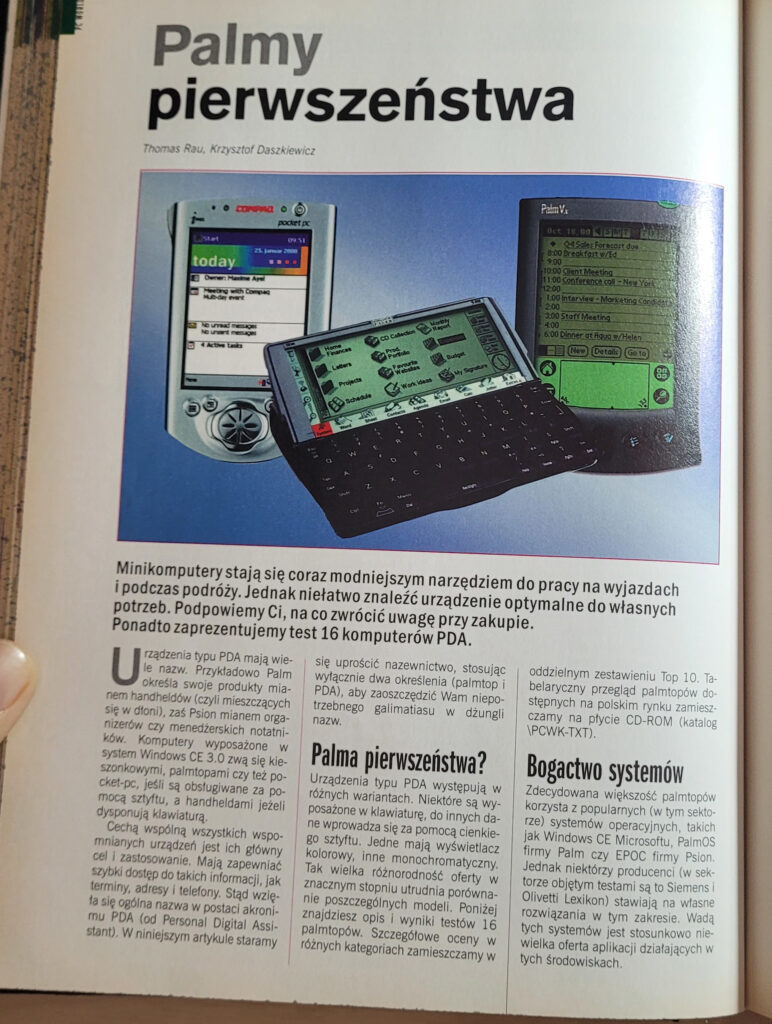

Ten sam numer PC World Komputera: bardzo mi bliski tekst o palmtopach, czyli ówczesnych małych komputerkach, tzw. asystentach osobistych, które miały dwie główne postacie, czy dwa główne typy sprzętu. Albo były to małe urządzonka z rozkładaną klawiaturą, przypominające małe laptopki, albo coś zbliżonego do współczesnych telefonów komórkowych, czyli urządzenie z ekranem ciekłokrystalicznym – w tamtych czasach były to ekrany rezystywne, które obsługiwało się rysikiem osadzanym gdzieś w obudowie.

Ceny palmtopów były bardzo różne. Powiedzmy wprost: to były urządzenia, których sprzedawało się w Polsce mało, bo były po prostu bardzo drogie. Najdroższe palmtopy w tym zestawieniu, czyli takie, które kosztowały około 4000 zł, to są w tamtych czasach dwie pensje. To dużo, dużo większy koszt w porównaniu do zarobków, niż dzisiaj najdroższa możliwa konfiguracja iPhone’a 17 Pro Max z największym dyskiem jaki jest. Palmtopy były po prostu drogie.

Oczywiście były też warianty, może nie tanie, ale względnie przyjazne cenowo. Na przykład klony palma produkcji firmy Vizor kosztowały 1200 zł, to nadal ponad połowa średniej pensji. No ale już dwa albo chyba dwa lata później udało mi się kupić na Allegro używanego Palma III za raptem kilkaset złotych, więc już w budżecie studenckim. Tak samo udało mi się potem dokupić jeszcze Palma V, który w opisywanym numerze kosztuje 2300 zł, a parę lat później był do wzięcia za ułamek tej kwoty. Ozdoba mojej kolekcji, czyli Psion Series V, kosztuje 3400 zł. Muszę się zebrać, sfotografować całą swoją kolekcję palmtopów i zaprezentować na blogu, bo jest na co popatrzeć.

Ciekawym tekstem w tym numerze PC World Komputera był artykuł o technologiach przyszłości. Było to zestawienie kilku różnych prognoz, przewidywań dotyczących różnych aspektów sprzętu komputerowego. No i gdy czytamy to z perspektywy 25 lat, no to możemy zdecydowanie powiedzieć, co zadziałało, co nie zadziałało. Dodajmy, że te rzeczy, które zadziałały, pojawiły się – wbrew nadziejom wyrażonym w artykule – raczej po 20 latach niż po 10. Ale niektóre zadziałały.

Pierwsza część artykułu dotyczy technologii Bluetooth, której nie było jeszcze wtedy na rynku, ale było wiadomo, że zbliża się, można było przeczytać specyfikację i zgadywać, jakie zastosowania będą najpopularniejsze. Autor tego tekstu ze swoimi przewidywaniami trafił tylko częściowo. Nie wiedział, że Bluetooth przyjmie się głównie do zastosowań audio i przewidywał, że będzie to standard komunikacji do wymiany danych. Dziś wiemy, że choć przez Bluetootha da się kilka zdjęć, o tyle był to zbyt wolny standard komunikacji, aby dało się np. przesłać za jego pomocą jakiś filmik. Tak więc Bluetooth – tak, zyskał popularność, ale głównie w audio.

W drugiej części tekstu autor przewiduje wzrost popularności biometrii, czyli logowania do komputera za pomocą obrazu siatkówki albo linii papilarnych. Ponownie: tak, biometria bardzo się spopularyzowała, ale nie do logowania do komputerów. W dzisiejszych czasach używamy jej do odblokowania naszych telefonów komórkowych.

Kolejna część, rozważania o e-papierze. Przypominam, mamy rok 2001. Pierwszy Kindle wszedł na rynek w roku 2007, czyli 6 lat później. Autor odgadł, że e-papier zyska na popularności, natomiast z lektury tekstu nie do końca wiadomo, czy wyobrażał go sobie jako sztywny ekran, czy może jako rzeczywisty, elastyczny odpowiednik papieru, na którym będzie można zmieniać treść. Ciężko powiedzieć – ale tak, to przewidywanie się sprawdziło, czytniki z e-papierem zyskały całkiem sporą popularność.

Kolejne przewidywanie, to przetwarzanie języka naturalnego. No i tutaj ciężko powiedzieć, czy autor trafił, czy nie trafił, bo w swoim eseju miesza mocno dwie rzeczy: technologię rozpoznawania tekstu mówionego i używanie tego rozpoznanego tekstu języka naturalnego do sterowania komputerem. Jeśli chodzi o rozpoznawanie mowy, to tak naprawdę problem jest rozwiązany i już od dawna potrafimy dyktować teksty naszym komputerom. Dzisiaj w epoce sieci neuronowych i wydajnych procesorów jest to praktycznie bezbłędne. Natomiast jeśli chodzi o użycie rozpoznanego tekstu do sterowania komputerem i realizowania zadań, to nawet w roku 2026, nawet z asystentami opartymi na dużych modelach językowych, to wciąż nie jest naturalny sposób interakcji z komputerem.

Ostatnia kategoria przewidywań, inteligentne roboty. No kurcze – nie ma. Nie mamy robotów, które potrafiłyby adaptować się do okoliczności i realizować zlecone zadania. To, co mamy w domach, to są co najwyżej inteligentne odkurzacze. No a przyznacie, że to jednak nie o to chodzi, gdy przewidujemy sobie przyszłość i obecność robotów w domach. Robotów nie ma.

Zerknąłem jeszcze do magazynu PC Kurier nr 3 z 2001 roku (przypominam, że był to dwutygodnik). No i nieodpartym wrażeniem jest, że ten magazyn był dla wszystkich i dla nikogo. To znaczy w jego treści było straszliwe mydło i powidło. Były tam wydarzenia z polskiego IT, były opisy jakichś nowości i trendów, były recenzje oprogramowania, ale także na przykład kursy programowania w asemblerze. Niby dla każdego coś miłego, ale biorąc pod uwagę, że w typowym numerze PC Kuriera mieliśmy za cztery razy więcej reklam niż treści redakcyjnych, to magazyn ciężko się czytało i tych treści nie było za dużo. Przy tak dużym rozstrzale tematycznym zniknął w 2003 roku – czyli od śmierci PC Kuriera w tej chwili dzielą nas jeszcze dwa lata.

To co zwróciło moją uwagę, to zestawienie CMS-ów do publikowania w internetach (Content Management System – system publikacji treści). Pamiętajmy, że mamy początek roku 2001, bańka internetowa już pęka, ale w Polsce z pewnym opóźnieniem. To znaczy nadal mamy portale, które dzisiaj nie istnieją, przywołam takie nazwy jak Ahoy albo Poland.com, Hoga, YoYo, Arena. Każdy z tych portali potrzebował jakiegoś systemu do zarządzania treścią, – niekoniecznie zbudowanego samodzielnie, mógł być to po prostu produkt z półki, używany przez redakcję do publikowania treści.

I teraz charakterystyczne jest to, że tych produktów, tych CMS-ów, wymieniono prawie 40. Ceny licencji tam podane były naprawdę wysokie, wynosiły tysiące lub wręcz dziesiątki tysięcy dolarów. I jak przeleciałem sobie po nazwach i po producentach, to… nie rozpoznałem ani jednego produktu i ani jednej marki producenta! To wszystko gdzieś przeminęło. Jeśli nawet któryś z tych produktów istnieje, to jest na tyle mało popularny, że ja go w ogóle nie kojarzę. Dla porównania: WordPress, który dziś napędza dwie trzecie internetu, powstanie w roku 2003, czyli dwa lata po krachu dotcomów. No i nie bez znaczenia dla jego popularności jest to, że to oprogramowaniem otwarte i dostępne za darmo.

W PC Kurierze 4/2001 interesujący jest tekst o outsourcingu i o urządzaniu datacenter, rozważania na temat tego, czy warto mieć serwerownię w firmie, czy warto ją może wyoutsourcować i trzymać sprzęt w profesjonalnych serwerowniach z szybkim internetem. Autor snuje rozważania, jak ten rynek będzie rósł i jak się będzie rozwijał w nadchodzących latach. I teraz: w roku 2001 nikt nie mógł wiedzieć, że już pięć lat później pojawi się AWS, czyli Amazon Web Services, że pojawi się usługa S3, maszyny wirtualne sprzedawane jako Amazon EC2. No mówiąc w skrócie – pięć lat później pojawiła się chmura i zmieniła wszystko. Więc te przewidywania dotyczące wzrostu istotności datacenter i outsourcingu, to wszystko zostało kompletnie przemielone kilka lat później.

Ostatni rozdział w dzisiejszym odcinku…

Luty 2006

Gdy zajrzymy do CHIP-a, znajdziemy tam artykuł o… systemie OS/2 produkcji firmy IBM! Tak, tym samym, który 11 lat wcześniej przegrał systemem Windows 95. Czytamy o tym, że IBM zdecydował o zakończeniu życia tego systemu, o tym, że aktualizacji nigdy już nie będzie i o tym, że grupa pasjonatów, która pracowała z tym systemem od początku jego istnienia, apeluje o otworzenie źródeł, aby mogli dopasowywać nowe sterowniki do nowego sprzętu i dalej pracować w swoim ulubionym systemie.

Kolejnym artykułem jest artykuł o sieciach peer-to-peer (P2P), to temat z okładki. Kilka lat wcześniej w internecie pojawiła się usługa Napster, niedługo później Kazaa. Obie te usługi pozwalały na wymienianie się plikami multimedialnymi, w szczególności muzyką w formacie MP3. Ponieważ obie te sieci były oparte o scentralizowane serwery, szybko zostały zlikwidowane, a na ich miejsce weszły sieci, które były w stanie wymieniać informacje, pozwalać użytkownikom dzielić pliki bez wyróżnionego centralnego serwera, który dałoby się zlikwidować. W artykule czytamy o czterech sieciach: Gnutella, FastTrack, eDonkey i BitTorrent. No i skądinąd wiadomo, że 20 lat później z tych czterech przeżył jedynie BitTorrent. Nie znaczy to, że pozostałe nie istnieją, ale nie odgrywają żadnej roli w dystrybucji plików, zarówno legalnych, jak i nielegalnych.

W tym samym numerze odnajdujemy listę przebojów 2005, czyli wyniki plebiscytu czytelników na najciekawsze produkty. W kategorii nagrywarek DVD mamy na przykład napęd LG: wszystkomający, wszystko potrafiący, czyli taki, który potrafił odczytywać i zapisywać wszystkie formaty na wszystkich rodzajach płytek. CD-R, RW, DVD-R, RW, w wariantach z plusem, minusem… Tak naprawdę ten napęd, był w stanie zrealizować każdą potrzebę użytkownika. Problem polegał tylko na tym, że tych potrzeb nagle zrobiło się mniej, bo w kategorii „pamięci masowe” wygrywa pendrive o pojemności 1 GB, czyli więcej niż nagrywalna płytka CD-R albo CD-RW. No, tak naprawdę to zmieniało troszkę sposób przenoszenia danych między komputerami, no i rola napędów optycznych bardzo szybko zaczęła maleć.

Widzimy jaka rewolucja dokonała się w obszarze monitorów. Produkt roku 2005 z tej kategorii to 19-calowy płaski wyświetlacz LCD, a przecież pamiętamy, że pięć lat wcześniej były to 17-calowe monitory bańkowe. Ciekawostka – w kategorii programy narzędziowe pierwsze miejsce zajmuje, tak samo jak pół dekady wcześniej, Total Commander, windowsowy klon legendarnego Norton Commandera (tak opisano go w tabelce).

W kategorii „Internet i komunikacja” pierwsze miejsce zajmuje przeglądarka Firefox 1.0, cytuję: „przeglądarka bijąca rekordy popularności, umożliwia wyświetlanie witryn w zakładkach, ma także wbudowaną obsługę kilku znanych wyszukiwarek, między innymi Google, Onet, Wikipedia. Funkcjonalność programu zwiększymy instalując wtyczki”. No i tu niestety, gdy przeskoczymy do roku 2026, Firefox szoruje po dnie. Jego udział w rynku jest jednocyfrowy i to mówimy o tych mniejszych liczbach jednocyfrowych.

W tym samym numerze CHIP-a 2/2006 odnajdujemy też artykuł o świeżo wprowadzanej podatkowej uldze na internet – czyli możliwości odliczenia od przychodu do 760 zł rocznie. Redakcja radzi przy tym, że jeśli ktoś wydaje na dostęp do internetu więcej, to może wziąć u operatora fakturę na dwie osoby i obie te osoby będą mogły odliczyć pieniądze wydane na internet do takiej właśnie kwoty. Tutaj największa ciekawostka (przypominam, nagrywam to w lutym 2026) – ta ulga nadal obowiązuje i nadal wynosi 760 zł do odliczenia w deklaracji rocznej. Różnica polega tylko na tym, że dziś można ją zastosować już tylko w dwóch kolejnych latach. Gdyby ktoś chciał to zrobić po raz pierwszy teraz, no to będzie sobie mógł odliczyć te 760 zł, jeśli tyle wydał, od przychodów osiągniętych w roku 2025, a za rok 2026.

Bardzo interesujący jest artykuł o polskich hostingach, czyli usługach utrzymywania stron internetowych. Oczywiście internet w roku 2006 to jest zupełnie co innego niż w roku 2026, więc nie będziemy mówić, że teraz znacznie lepsze usługi są dużo tańsze, bo to oczywiste. Natomiast ciekawe jest to, że w ramach tego artykułu redakcja odradzała używanie usług niektórych firm, bo serwery realizujące hosting były nieodpowiednio zabezpieczone i istniała na przykład możliwość podglądania zasobów innych użytkowników albo podejmowania prób łamania ich haseł. W dzisiejszych czasach tego typu raporty raczej nie pojawiłyby się na łamach ogólnopolskiego miesięcznika.

Przejdźmy do PC World Komputera, numer 2/2006. Odnajdujemy tam artykuł o komunikatorach i był to chyba okres ich największego rozkwitu. Nie mam na myśli tego, że miały tak duże możliwości, ale raczej, że było ich tak wiele, tyle różnych marek. Charakterystyczne jest to, że do dzisiejszych czasów, czyli do roku 2026, nie przetrwał w zasadzie żaden produkt. Okej, niektóre marki, takie jak np. Gadu-Gadu, mogą jeszcze istnieć, ale tak naprawdę mają znikomy udział w rynku i nie odgrywają żadnej istotnej roli. Marki, które pojawiały się w artykule to Yahoo Messenger, Gadu-Gadu, Tlen, Skype, ICQ i MSN Messenger.

Pojawia się też Google Talk i to jest jeden ze 147 komunikatorów Google, które pojawiły się na przestrzeni ostatniego ćwierćwiecza. Przesadziłem troszkę dla efektu. Natomiast w 2021 roku w portalu Ars Technica pojawiło się wspaniałe zestawienie wszystkich produktów Google, które miały funkcję instant messengera, czyli jakiejś formy komunikatora internetowego. I ich było wtedy ponad 20. I to jasno pokazywało, że co jak co, ale Google nie potrafi dostarczyć użytkownikom komunikatora, który przeżyłby w dobrym zdrowiu dłużej niż rok. Okej, w dawnych czasach Google Talk przeżył chyba z 5 lat, no ale potem, gdy został zlikwidowany, to żaden komunikator Google nie powtórzył już tego sukcesu. Artykuł wspomina też multikomunikatory, czyli aplikacje takie jak Miranda, AQQ albo Gaim, które potrafiły komunikować się z wieloma różnymi sieciami instant messengerów i wyświetlać kontakty, które mieliśmy w tych różnych sieciach, w obrębie jednego programu.

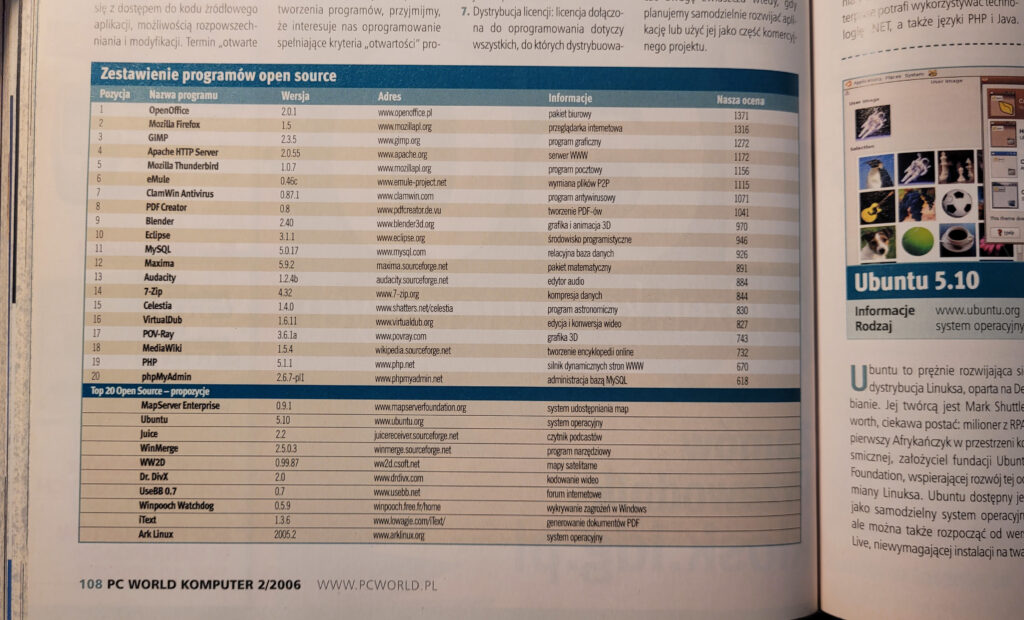

Innym ciekawym zestawieniem obecnym w tym numerze jest złota dwudziestka open source. Gdy popatrzymy sobie na 20 wymienionych klasyków, to uderza nas, jak wiele aplikacji żyje po dziś dzień i ma się po dziś dzień bardzo dobrze. Tak jak na przykład Open Office, albo Firefox, GIMP, Audacity. Na 20 wymienionych pozycji spokojnie 10 nadal jest aktywnie używanych, rozwijanych i należy rzeczywiście do kolekcji klasyki. Oczywiście zdarzają się produkty, które przestały być rozwijane, bo przestały być potrzebne. Na przykład produkt open source’owy o nazwie PDF Creator nie jest potrzebny w czasach, kiedy Windows sam z siebie ma drukarkę pozwalającą tworzyć PDF-y, a dodatkowo prawie każdy istotny program ma natywną opcję zapisywania PDF-ów. Tym niemniej takie pozycje jak Blender, VirtualDub, czy PHPMyAdmin istnieją do dzisiaj i w swoich niszach mają niewiele konkurencji.

Ostatnim artykułem, o którym chciałbym powiedzieć, jest tekst „Wyścig zbrojeń” o krajobrazie zagrożeń internetowych z roku 2006. Tak naprawdę był to krajobraz zupełnie inny niż ten, który mamy dzisiaj. Po pierwsze, internet był wolniejszy. Po drugie, szyfrowania w internecie było dużo, dużo mniej. I tak naprawdę oprogramowanie, czy złośliwi ludzie, którzy chcieli zrobić jakąś krzywdę, mieli znacznie szersze pole do popisu, znacznie więcej możliwości nadużyć.

Jeśli chodzi o oprogramowanie instalowane na komputerach użytkowników, bardzo popularne było na przykład to, że programy dostępne za darmo były dołączane z jakimiś wrzutkami, na przykład darmową próbną wersją antywirusa. Albo jakąś wtyczką do przeglądarki. Albo oprogramowaniem, które miało pomagać, a tak naprawdę okazywało się na przykład softem, który atakował użytkownika wyskakującymi okienkami z reklamami, albo produktem, który przestawiał proxy przeglądarki internetowej na jakiś szemrany adres, po to, aby przepuścić ruch użytkownika przez maszynę atakującego.

Tak naprawdę krajobraz zagrożeń internetowych był najeżony pułapkami dużo bardziej niż dzisiaj. Nie było jeszcze na przykład listy ostrzeżeń przed złośliwymi domenami, które automatycznie wczytywane są w przeglądarkach. Nie było listy domen niebezpiecznych CERT Polska. Jeśli ktoś nie miał antywirusa, to pozostawał zasadniczo bezbronny, bo Microsoft dopiero testował produkt, który miał stać się Windows Defenderem. Raczkowały blokery reklam. Takie pluginy do przeglądarek jak ekstremalnie wtedy popularny Adobe Flash żądały częstych aktualizacji, które polegały na tym, żeby użytkownik miał sobie ściągnąć plik EXE i go uruchomić. No i łatwo się domyślić, że niektórym tak to weszło w krew, że nie sprawdzali co, skąd ściągają. I bardzo łatwo wtedy było ściągnąć na swój komputer, jaki soft, który na przykład czynił go częścią botnetu.

Z drugiej strony w krajobrazie zagrożeń nie było jeszcze popularnego dziś ransomware, czyli sytuacji, w której zasoby naszego komputera zostają zaszyfrowane, a złoczyńca żąda okupu albo za ich odszyfrowanie, albo – gdy już zapłacimy za odszyfrowanie – dodatkowych pieniędzy za nieujawnianie tych danych, które udało mu się pobrać z naszego komputera. Dodajmy też, że w roku 2006 nie było kryptowalut. Pojawiły się dopiero w 2009 roku, wtedy zadebiutował Bitcoin. Zresztą przez pierwsze lata Bitcoina interesowali się nim głównie anarchiści i libertarianie. Dopiero parę lat później okazało się, że tak naprawdę największymi beneficjentami Bitcoina i innych kryptowalut są przestępcy, którzy zyskali możliwość pobierania okupu w sposób bezpieczny lub przynajmniej względnie bezpieczny.

Podsumowanie

I to już wszystko. Dojechaliśmy do końca dzisiejszego odcinka. Dodam, że do końca pierwszego odcinka – dlatego jestem szczególnie ciekaw, czy taka formuła, czy taki format podoba wam się. Nagrywam te słowa pod koniec lutego 2026. I umówmy się, że jeśli słuchasz to w lutym albo marcu tego roku, napisz mi proszę maila – co się podobało, co się nie podobało, żebym wiedział co i jak robić lepiej.

Natomiast jeśli jest kwiecień 2026 lub później, to oznacza, że jest już kolejny odcinek. Więc zanim wyślesz mi maila, to przesłuchaj proszę następny odcinek – i daj znać dopiero po tamtym. Bo bardzo jestem ciekaw opinii, a to, czy ten cykl będzie toczył się dalej, będzie zależało m.in. od zaangażowania słuchaczy. Tak więc bardzo dziękuję za uwagę. Czekam na maile (tomasz.zielinski@gmail.com).

I do usłyszenia za miesiąc w odcinku marcowym: marzec 1996, marzec 2001 i marzec 2006. Tymczasem!

O autorze: zawodowy programista od 2003 roku, pasjonat bezpieczeństwa informatycznego. Rozwijał systemy finansowe dla NBP, tworzył i weryfikował zabezpieczenia bankowych aplikacji mobilnych, brał udział w pracach nad grą Angry Birds i wyszukiwarką internetową Microsoft Bing.

19 odpowiedzi na “Pierwszy odcinek retro-podcastu, jeszcze bez nazwy”

Mam jeszcze płytki z tych starych numerów i pamiętam że co pewien czas było archiwum całych roczników do łatwego przeglądania. Może chcesz?

Jeśli są tam PDF-y z rocznikami, to chcę. Jeśli jakieś dziwne HTML-owe kompilacje w CHM, to poproszę jednego do oceny.

Niestety to aplikacja „e-Kiosk Reader” i format .wyd

Z aplikacji można drukować jedynie pojedyncze strony w formacie graficznym.

Widziałem dyskusję na forum.eksiazki.org i nie poradzili sobie z analizą tego formatu.

Super wspominki, łezka się w oku kręci jak przypomnę sobie te nagrywanie płyt 😅

Czy ten blokowa sieć miała coś wspólnego Freesco, lub NND? Ostatnio zrobiłem retro router na Freesco i wszystko śmigało pięknie.

Super materiał. Retro to teraz prawie tylko gracze i emulacja, a o programowaniu, czy administracji to trzeba dużo szukać.

W mojej sieci miałem Linuksa z kartą ISDN i skryptami podnoszącymi połączenie 2×64 kbps w świat (szybciej i taniej, niż SDI!)

Miło powspominać. Bardzo dziękuję za wersję dla czytelników, nie tylko słuchaczy i telewidzów.

Panie Tomku pozwolę obie zaprotestować! To że PCet pierdział w covoxa nie oznaczało że na komputerach nie była tworzona muzyka elektroniczna! Amiga miała wewnętrzne przetworniki 16bit stereo i była cała olbrzymia scena tworząca muzykę. Dzięki DMA muzyka przenigdy nie zacięła się, na Amidze można było podłączyć dodatkowe floppy, kopiować dyski na krzyż przeglądać HDD, otwierać archiwa i to wszystko w tym samym czasie. PC wiele lat po tym nadal nie potrafił zrobić kilku operacji na raz i muzyka przycinała się co było moim głównym punktem do szyderstw. multitasking…. tak w wykonaniu Intela…

Proszę pamiętać też o Atari które miało doskonały soft do obsługi systezatorow i miało wbudowane midi, zapewne wielu muzyków używało Atari.

Bajtek był świetny, próbował zachować to co wartościowe, niestety rynek został zalany przez chłam znany pod nazwą PC 386SX. Programował Pan kiedyś w asmblerze? Co było głównym zadaniem programisty Intela? żonglerka rejestrami, proszę porównać do Motoroli na której była oparta Amiga i Atari. Ale cena czyni cuda i tak jak w przypadku VHS wygrał śmieć za to użytkownicy zostali zwindykowani stukrotnie przez kolejne upgrade to koprocesor to szybszy zegar to obsługa ram powyżej 640kb…. Długo by pisać, to było zresztą codziennym tematem potyczek Amigowcow i PCtowcow

Poprawka Amiga miała 4 przetworniki 8 bitowe, po pewnych softwarowych kombinacjach można było uzyskać 14 bit (8 bitów audio + 6 bitów głośności)

Czytam sobie, czytam, nostalgia mnie ogarnia (bo PC World to było moje pierwsze miejsce poważnej pracy przez kilka lat od przełomu 1999/2000), a tu nagle widzę mój własny tekst – „Krok w przyszłość” z PC Worlda z 2001 r. Miałem 21 lat, jak go pisałem, i bardzo dużo pewności siebie co do zrozumienia przyszłości komputerów… :-). You made my day.

Przez wiele lat kolekcjonowałem czasopisma komputerowe i growe. Najstarszy w kolekcji mam magazyn „Bajtek”. Niestety dwóch pierwszych numerów już nie da się nigdzie zdobyć.

A nie ma gdzieś na archive.org ?

Mogę zaproponować nazwę podcastu: Retrowizje

Super pomysł. Już czekam na kolejny odcinek. Uwag krytycznych nie mam, same pochwały.

Dziś żałuję że wywaliłem gazety komputerowe z lat 80, 90 i 00 choć nie były to kompletne roczniki. Najbardziej żal oczywiście tych z lat 80. Jednak przez ostatnie dekady udało mi się zebrać w formie skanów *niemal* wszystko co w Polsce się ukazało się na papierze, z obrazami cover dysków włącznie. W tym tytuły których nigdy nie miałem w ręku, kojarzone tylko z witryn kioskowych. Jednak nie ma i nie było nigdy w sieci dostępnego wszystkiego. Mnie osobiście najbardziej doskwiera brak skanów PC Kuriera, są dostępne chyba tylko 4 numery. Nie ma znaczenia że było to pismo zapchane reklamami chyba bardziej nawet niż Chip, w końcu te reklamy po 30 i więcej latach też stanowią jakiś zasób wiedzy i znak czasu.

Też mi się kiedyś zebrało na wspomnienia. Można linkować? Jeśli tak, to proszę: https://zapisywacz-rzeczy.blogspot.com/2017/07/panowie-szanujmy-wspomnienia.html

U mnie to bardziej poszło w uruchamianie DOS-a i dawnych Windows w maszynie wirtualnej, ale wspomniałem też o magazynach. Miałem, wyrzuciłem, teraz żałuję. Moim zdaniem nigdy wcześniej i później nie było tak znakomitych czasopism, jak Enter i PC Kurier w połowie lat 90.

(Czekam niecierpliwie na nazwę podcastu, bo wolę ściągać w AntennaPod niż streamować z YT. Może taka zaskakująca: Informatyk Zakładowy?)

jak zwykle kawał materialu zebranego w pigułce. Chip na tamte czasy wcale nie byl tani, ale dla kogos bez stalego dostepu do netu to byla dobra baza programow i duzo ciekawej wiedzy. Chyba dzieki tej gazecie wdrozylem sie w ten swiat. Pozniej Linux+ i Hackin9

Aż się łezka w oku kręci

Ech miło było posłuchać i powspominać. Do dzisiaj pamiętam, że trzeba było odizolować pin B21 w slot1, żeby przestawić magistralę celerona 300A na 100MHz. Wtedy można było powiedzieć, że rycerz na prawdę galopuje w HOMM3 (albo 4 już nie pamiętam 😉